- ИИ и "Алгоритмическая Невидимость": Когда технологии решают за нас

- Что такое "алгоритмическая невидимость"?

- Примеры "алгоритмической невидимости" в нашей жизни

- Почему "алгоритмическая невидимость" – это проблема?

- Что можно сделать?

- Повышение прозрачности алгоритмов

- Разработка этических стандартов

- Регулирование ИИ

- Образование и осведомленность

- Наш личный опыт

ИИ и "Алгоритмическая Невидимость": Когда технологии решают за нас

В наш век стремительного развития технологий, искусственный интеллект (ИИ) проникает во все сферы нашей жизни․ Он помогает нам в работе, развлечениях, обучении и даже в принятии важных решений․ Но вместе с удобством и эффективностью, которые приносит ИИ, возникает и ряд серьезных вопросов․ Один из самых актуальных – это проблема "алгоритмической невидимости", когда решения, принимаемые алгоритмами, становятся непрозрачными и непонятными для нас․

Мы, как пользователи, все чаще сталкиваемся с ситуациями, когда ИИ определяет, какую рекламу мы видим, какие новости читаем, какие фильмы смотрим и даже какие кредиты нам одобряют․ И часто мы не понимаем, почему были приняты именно такие решения․ Это создает ощущение, что нами управляет невидимая рука алгоритма, что может привести к ощущению беспомощности и недоверия к технологиям․

Что такое "алгоритмическая невидимость"?

Алгоритмическая невидимость – это ситуация, когда работа алгоритма, принимающего решения, скрыта от пользователя․ Мы не знаем, какие данные используются, какие факторы учитываются и как именно алгоритм приходит к своим выводам․ Это может происходить по разным причинам: сложность самого алгоритма, коммерческая тайна компаний, разрабатывающих ИИ, или просто недостаток прозрачности в процессе принятия решений․

Представьте, например, что вам отказывают в кредите․ Банк сообщает, что решение принято на основе анализа вашей кредитной истории, но не объясняет, какие именно факторы повлияли на отказ․ Возможно, алгоритм посчитал, что вы относитесь к группе риска из-за вашего возраста, места жительства или профессии․ Вы не можете оспорить это решение, потому что не знаете, на чем оно основано․

Примеры "алгоритмической невидимости" в нашей жизни

Проблема алгоритмической невидимости проявляется во многих областях:

- Социальные сети: Алгоритмы Facebook, Instagram и других платформ определяют, какие посты мы видим в своей ленте․ Они могут формировать нашу картину мира, ограничивая нас информацией, которая не соответствует нашим убеждениям․

- Поиск работы: Системы автоматического отбора резюме могут отсеивать кандидатов, основываясь на критериях, которые мы не знаем и не понимаем․ Это может приводить к дискриминации и несправедливости․

- Медицина: ИИ все чаще используется для диагностики заболеваний и принятия решений о лечении․ Но если врач не понимает, как ИИ пришел к своему выводу, он не может доверять ему безоговорочно․

- Правосудие: В некоторых странах ИИ используется для оценки риска рецидива преступников․ Но если алгоритм предвзят, он может приводить к несправедливым приговорам․

Почему "алгоритмическая невидимость" – это проблема?

Алгоритмическая невидимость представляет собой серьезную угрозу для нашего общества․ Вот несколько причин:

- Отсутствие подотчетности: Если мы не знаем, как работает алгоритм, мы не можем привлечь его к ответственности за ошибки или предвзятость․

- Дискриминация: Алгоритмы могут неосознанно воспроизводить и усиливать существующие социальные неравенства․

- Потеря контроля: Мы теряем контроль над собственной жизнью, когда решения за нас принимают невидимые алгоритмы․

- Подрыв доверия: Непрозрачность алгоритмов подрывает доверие к технологиям и институтам, которые их используют․

"Технологии – это всего лишь инструмент․ Важно, как мы его используем․" ─ Билл Гейтс

Что можно сделать?

Решение проблемы "алгоритмической невидимости" требует комплексного подхода, включающего:

Повышение прозрачности алгоритмов

Разработчики ИИ должны стремиться к тому, чтобы их алгоритмы были понятными и объяснимыми․ Это означает, что они должны предоставлять информацию о том, какие данные используются, какие факторы учитываются и как принимаются решения․

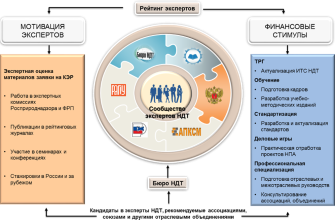

Разработка этических стандартов

Необходимо разработать четкие этические стандарты для разработки и использования ИИ․ Эти стандарты должны учитывать принципы справедливости, недискриминации и подотчетности․

Регулирование ИИ

Правительства должны разработать законодательство, регулирующее использование ИИ в различных сферах․ Это законодательство должно обеспечивать защиту прав потребителей и предотвращать злоупотребления․

Образование и осведомленность

Необходимо повышать осведомленность общественности о проблемах, связанных с ИИ, и обучать людей критически оценивать решения, принимаемые алгоритмами․

Наш личный опыт

Мы сами не раз сталкивались с проявлениями "алгоритмической невидимости"․ Например, однажды наша страница в социальной сети была заблокирована без объяснения причин․ Мы пытались связаться с администрацией, но так и не получили внятного ответа․ Это было очень неприятно и заставило нас задуматься о том, насколько сильно мы зависим от алгоритмов, контролирующих нашу жизнь в интернете․

Другой пример – это реклама, которую мы видим в интернете․ Часто она кажется совершенно нерелевантной нашим интересам․ Мы понимаем, что алгоритмы стараются показывать нам то, что, по их мнению, нам понравится, но иногда это приводит к абсурдным ситуациям․ Это показывает, что алгоритмы еще далеки от совершенства и что нам нужно быть критичными к информации, которую они нам предоставляют․

Проблема "алгоритмической невидимости" – это серьезный вызов для нашего общества․ Мы должны осознавать ее масштабы и принимать меры для ее решения․ Только так мы сможем обеспечить, чтобы ИИ служил на благо человечества, а не становился инструментом контроля и манипуляции․ Нам необходимо требовать прозрачности и подотчетности от разработчиков ИИ и активно участвовать в обсуждении этических и социальных вопросов, связанных с его развитием․

Подробнее

| LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос |

|---|---|---|---|---|

| Влияние ИИ на общество | Этика искусственного интеллекта | Прозрачность алгоритмов | Алгоритмическая дискриминация | Регулирование ИИ |

| ИИ в социальных сетях | ИИ и приватность | Объяснимый ИИ | Последствия алгоритмизации | Ответственность за ИИ |