- ИИ и Душа: Этика Психологической Помощи в Эпоху Алгоритмов

- Почему Этика ИИ в Психологии – Это Важно

- Основные Этические Вопросы

- Конфиденциальность: Священное Право на Личное

- Прозрачность: Понимание Механизмов

- Ответственность: Кто Заплатит по Счетам?

- Будущее Психологической Помощи: Симбиоз Человека и Машины

- Рекомендации для Разработчиков и Пользователей

ИИ и Душа: Этика Психологической Помощи в Эпоху Алгоритмов

Приветствую вас, дорогие читатели! Сегодня мы погрузимся в захватывающий и, признаться, немного тревожный мир, где искусственный интеллект (ИИ) встречается с самым сокровенным – человеческой душой. Мы поговорим об этике использования ИИ в сфере психологической помощи. Это тема, которая касается каждого из нас, ведь рано или поздно мы все можем столкнуться с ситуацией, когда именно алгоритм, а не человек, предложит нам поддержку в трудную минуту.

Мы живем во времена, когда технологии развиваются с головокружительной скоростью. ИИ уже умеет писать статьи, создавать музыку и даже диагностировать болезни. Неудивительно, что он проник и в сферу психологии, предлагая чат-ботов для борьбы с тревогой, приложения для медитации и даже системы, способные анализировать наше настроение по голосу. Но насколько этично полагаться на машины в вопросах, требующих глубокого понимания, эмпатии и человеческого тепла?

Почему Этика ИИ в Психологии – Это Важно

Этика ИИ в психологии – это не просто модная тема для обсуждения на конференциях. Это вопрос, который напрямую влияет на наше психическое здоровье и благополучие. Представьте себе ситуацию: вы переживаете тяжелый период в жизни и обращаетесь за помощью к ИИ-терапевту. Он внимательно "слушает" вас, анализирует ваши слова и выдает рекомендации. Но может ли машина по-настоящему понять вашу боль? Способна ли она сопереживать вашим чувствам? И что произойдет, если алгоритм ошибется в своих выводах?

Рисков здесь немало. Во-первых, это конфиденциальность. Как защитить личные данные, которыми мы делимся с ИИ? Кто будет нести ответственность, если эта информация попадет в чужие руки? Во-вторых, это зависимость. Не приведет ли использование ИИ-терапевтов к тому, что люди разучатся общаться друг с другом и искать поддержку в реальном мире? И, наконец, это качество помощи. Сможет ли ИИ заменить настоящего психолога, обладающего опытом, интуицией и способностью к эмпатии?

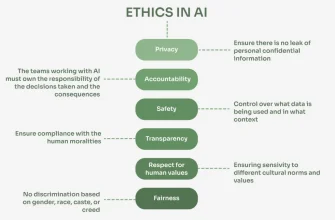

Основные Этические Вопросы

Давайте рассмотрим основные этические вопросы, которые возникают в связи с использованием ИИ в психологической помощи:

- Конфиденциальность данных: Как обеспечить безопасность и конфиденциальность личной информации, которую пользователи предоставляют ИИ-системам?

- Прозрачность алгоритмов: Насколько понятны и прозрачны алгоритмы, лежащие в основе ИИ-терапевтов? Можем ли мы доверять системе, если не понимаем, как она работает?

- Ответственность: Кто несет ответственность за ошибки или негативные последствия, вызванные использованием ИИ в психологической помощи?

- Замена человеческого контакта: Не приведет ли широкое распространение ИИ-терапевтов к уменьшению человеческого контакта и ухудшению социальных навыков?

- Доступность: Обеспечит ли ИИ более широкий доступ к психологической помощи для людей, которые не могут позволить себе традиционную терапию?

- Предвзятость: Как избежать предвзятости в алгоритмах ИИ, которая может привести к дискриминации определенных групп населения?

Конфиденциальность: Священное Право на Личное

Конфиденциальность – это краеугольный камень любой психотерапии. Мы должны быть уверены, что все, что мы говорим психологу, останется между нами. Но как обеспечить конфиденциальность, когда речь идет об ИИ? Ведь все данные, которые мы вводим в систему, хранятся на серверах и могут быть потенциально доступны третьим лицам.

Необходимо разработать строгие правила и протоколы, регулирующие сбор, хранение и использование личных данных в сфере психологической помощи с использованием ИИ. Пользователи должны иметь право знать, как используются их данные, и контролировать доступ к ним. Кроме того, важно проводить регулярные аудиты безопасности, чтобы выявлять и устранять потенциальные уязвимости.

"Технологии без этики — это катастрофа, ожидающая своего часа."

— Альберт Эйнштейн

Прозрачность: Понимание Механизмов

Большинство из нас не понимает, как работают алгоритмы ИИ. Мы просто доверяем им, полагаясь на то, что они сделают правильный выбор. Но в сфере психологии это может быть опасно. Мы должны понимать, как ИИ принимает решения, чтобы оценить, насколько они обоснованы и соответствуют нашим потребностям.

Разработчики ИИ-систем должны стремиться к максимальной прозрачности своих алгоритмов. Они должны объяснять, какие данные используются для обучения системы, какие факторы влияют на ее решения и как пользователи могут оспорить эти решения. Только в этом случае мы сможем доверять ИИ в вопросах, касающихся нашего психического здоровья.

Ответственность: Кто Заплатит по Счетам?

Что произойдет, если ИИ-терапевт даст нам плохой совет, который приведет к негативным последствиям? Кто будет нести ответственность за это? Разработчик системы? Психолог, который ее курирует? Или сам пользователь, который доверился машине?

Этот вопрос пока остается без ответа. Необходимо разработать четкие юридические рамки, определяющие ответственность за ошибки и негативные последствия, вызванные использованием ИИ в психологической помощи. Возможно, потребуется создание специальных страховых фондов, которые будут компенсировать ущерб, причиненный пользователям некачественной помощью.

Будущее Психологической Помощи: Симбиоз Человека и Машины

Несмотря на все этические вопросы, мы верим, что ИИ может сыграть положительную роль в сфере психологической помощи. Он может помочь нам сделать терапию более доступной, эффективной и персонализированной. Но для этого необходимо соблюдать строгие этические принципы и помнить, что машина – это всего лишь инструмент, а не замена человеческому теплу и сочувствию.

Мы видим будущее психологической помощи не как замену человека машиной, а как симбиоз человека и машины. Психологи будут использовать ИИ для анализа данных, выявления закономерностей и разработки индивидуальных планов лечения. А пациенты будут получать от ИИ поддержку, информацию и инструменты для самопомощи. Но окончательное решение всегда останется за человеком.

Нам кажется, что важно помнить, что развитие ИИ в психологии – это не гонка за технологическим прогрессом, а стремление сделать жизнь людей лучше. Мы должны подходить к этому процессу с осторожностью, ответственностью и глубоким пониманием человеческой природы.

Рекомендации для Разработчиков и Пользователей

- Для разработчиков:

- Разрабатывайте ИИ-системы с учетом этических принципов и требований конфиденциальности.

- Обеспечивайте прозрачность алгоритмов и возможность их объяснения.

- Проводите регулярные аудиты безопасности и тестирования системы.

- Обучайте ИИ-системы на разнообразных данных, чтобы избежать предвзятости.

- Сотрудничайте с психологами и другими специалистами в области психического здоровья.

- Для пользователей:

- Изучайте информацию о ИИ-системе, прежде чем начать ее использовать.

- Узнавайте, как используются ваши данные и какие меры безопасности применяются.

- Не полагайтесь на ИИ-систему как на единственного источника помощи.

- Обращайтесь к профессиональным психологам, если чувствуете, что вам нужна более квалифицированная помощь.

- Делитесь своим опытом использования ИИ-систем, чтобы помочь другим пользователям.

Мы надеемся, что эта статья помогла вам лучше понять этические вопросы, связанные с использованием ИИ в сфере психологической помощи. Помните, что технологии должны служить нам, а не наоборот. И только вместе мы можем создать будущее, в котором ИИ будет помогать нам заботиться о нашем психическом здоровье и благополучии.

Подробнее

| ИИ в психотерапии | Этика искусственного интеллекта | Психологическая помощь онлайн | Конфиденциальность в ИИ | Риски ИИ в психологии |

|---|---|---|---|---|

| Будущее психологии | ИИ и психическое здоровье | Чат-боты для терапии | Алгоритмы в психологии | Эмпатия ИИ |