- ИИ и манипуляция общественным мнением: Как технологии меняют наше восприятие реальности

- Что такое манипуляция общественным мнением и почему это важно?

- Как ИИ используется для манипуляции общественным мнением?

- Примеры использования ИИ для манипуляции

- Последствия манипуляции общественным мнением с помощью ИИ

- Как защититься от манипуляции общественным мнением с помощью ИИ?

ИИ и манипуляция общественным мнением: Как технологии меняют наше восприятие реальности

Мы живем в эпоху беспрецедентного технологического прогресса, где искусственный интеллект (ИИ) проникает во все сферы нашей жизни․ От алгоритмов, рекомендующих нам товары и фильмы, до систем, анализирующих наши медицинские данные, ИИ становится незаменимым помощником․ Однако, вместе с огромными возможностями, которые он открывает, возникают и серьезные риски, особенно в контексте манипуляции общественным мнением․

Мы, как общество, должны осознавать, что ИИ – это мощный инструмент, который может быть использован как во благо, так и во вред․ И сегодня мы поговорим о том, как именно ИИ может быть использован для манипуляции общественным мнением, какие последствия это может иметь, и что мы можем сделать, чтобы защитить себя и наше общество от этой угрозы․

Что такое манипуляция общественным мнением и почему это важно?

Манипуляция общественным мнением – это процесс намеренного воздействия на убеждения, взгляды и поведение людей с целью достижения определенных целей․ Это может быть политическая пропаганда, продвижение коммерческих продуктов или услуг, или даже распространение дезинформации для создания хаоса и недоверия․

Важность понимания механизмов манипуляции общественным мнением заключается в том, что она может подорвать демократические процессы, привести к принятию неверных решений, и даже спровоцировать конфликты и насилие․ Когда люди не могут отличить правду от лжи, когда их убеждения формируются под влиянием скрытых сил, они теряют контроль над своей жизнью и становятся марионетками в чужих руках․

Как ИИ используется для манипуляции общественным мнением?

ИИ предоставляет манипуляторам беспрецедентные возможности для воздействия на общественное мнение․ Вот лишь некоторые из способов, которыми ИИ может быть использован:

- Генерация фейковых новостей и дипфейков: ИИ может создавать реалистичные поддельные видео, аудио и текстовые материалы, которые трудно отличить от настоящих․ Эти материалы могут быть использованы для дискредитации политических оппонентов, распространения ложной информации о событиях, и даже для создания паники и хаоса․

- Таргетированная реклама и пропаганда: ИИ может анализировать огромные объемы данных о пользователях, чтобы выявлять их интересы, убеждения, страхи и слабости․ Эта информация может быть использована для создания персонализированной рекламы и пропаганды, которая будет максимально эффективной в воздействии на конкретных людей или группы․

- Создание ботов и троллей: ИИ может создавать ботов и троллей, которые имитируют поведение реальных людей в социальных сетях и на форумах․ Эти боты и тролли могут распространять дезинформацию, разжигать ненависть и вражду, и даже вмешиваться в политические дискуссии․

- Искажение результатов поиска: ИИ может использоваться для изменения результатов поиска в интернете, чтобы продвигать определенные точки зрения и скрывать другие․ Это может затруднить доступ к объективной информации и привести к тому, что люди будут получать искаженное представление о мире․

Примеры использования ИИ для манипуляции

К сожалению, примеров использования ИИ для манипуляции общественным мнением становится все больше․ Вот лишь некоторые из них:

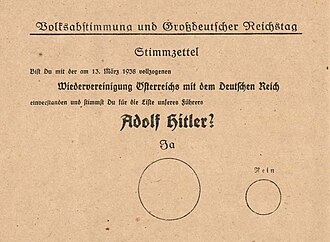

- Вмешательство в выборы: ИИ может использоваться для распространения дезинформации о кандидатах, для создания фейковых новостей о ходе голосования, и даже для взлома систем голосования․

- Разжигание ненависти и вражды: ИИ может использоваться для создания и распространения контента, который разжигает ненависть и вражду между различными группами населения․

- Продвижение дезинформации о здоровье: ИИ может использоваться для распространения ложной информации о вакцинах, лекарствах и других медицинских темах․

"Нельзя доверять компьютеру, который не можешь выбросить в окно․"

Последствия манипуляции общественным мнением с помощью ИИ

Последствия манипуляции общественным мнением с помощью ИИ могут быть катастрофическими․ Они включают в себя:

- Поляризация общества: Манипуляция общественным мнением может привести к углублению разногласий между различными группами населения и к усилению поляризации общества․

- Подрыв демократических институтов: Манипуляция общественным мнением может подорвать доверие к демократическим институтам и привести к тому, что люди перестанут верить в возможность перемен через выборы и другие демократические механизмы․

- Рост насилия и конфликтов: Манипуляция общественным мнением может спровоцировать насилие и конфликты между различными группами населения․

- Утрата доверия к информации: Постоянное распространение дезинформации может привести к тому, что люди перестанут доверять любым источникам информации, включая СМИ, научные исследования и даже личные наблюдения․

Как защититься от манипуляции общественным мнением с помощью ИИ?

Защита от манипуляции общественным мнением с помощью ИИ – это сложная задача, которая требует комплексного подхода․ Вот некоторые шаги, которые мы можем предпринять:

- Повышение медиаграмотности: Мы должны научиться критически оценивать информацию, которую мы получаем из различных источников․ Мы должны уметь отличать правду от лжи, выявлять пропаганду и дезинформацию, и понимать, как работают алгоритмы социальных сетей․

- Разработка этических норм для ИИ: Мы должны разработать этические нормы для разработки и использования ИИ, которые будут учитывать риски манипуляции общественным мнением․ Эти нормы должны включать в себя требования прозрачности, ответственности и подотчетности․

- Регулирование социальных сетей: Мы должны регулировать социальные сети, чтобы они не использовались для распространения дезинформации и пропаганды․ Это может включать в себя требования к социальным сетям удалять фейковые аккаунты, маркировать контент, созданный ботами, и предоставлять пользователям возможность сообщать о дезинформации․

- Поддержка независимой журналистики: Мы должны поддерживать независимую журналистику, которая играет важную роль в разоблачении дезинформации и предоставлении объективной информации․

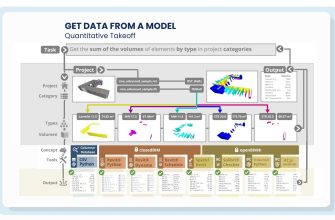

- Развитие технологий для борьбы с дезинформацией: Мы должны развивать технологии, которые помогут нам выявлять и бороться с дезинформацией․ Это может включать в себя разработку инструментов для проверки фактов, для анализа контента и для выявления ботов и троллей․

ИИ – это мощный инструмент, который может быть использован как во благо, так и во вред․ Мы должны осознавать риски манипуляции общественным мнением с помощью ИИ и принимать меры для защиты себя и нашего общества от этой угрозы․ Повышение медиаграмотности, разработка этических норм для ИИ, регулирование социальных сетей, поддержка независимой журналистики и развитие технологий для борьбы с дезинформацией – это лишь некоторые из шагов, которые мы можем предпринять․

Будущее нашего общества зависит от того, сможем ли мы обуздать мощь ИИ и использовать его во благо, а не во вред․ Мы должны быть бдительными, критически оценивать информацию, которую мы получаем, и бороться за правду и справедливость․

Подробнее

| ИИ и дезинформация | Манипуляция в соцсетях | Фейковые новости и ИИ | AI в политической пропаганде | Медиаграмотность и ИИ |

|---|---|---|---|---|

| Дипфейки и общественное мнение | Этические нормы ИИ | Борьба с дезинформацией | Влияние ИИ на выборы | ИИ и поляризация общества |