- ИИ и Проблема "Алгоритмического Бездействия": Когда Машина Молчит

- Что такое "Алгоритмическое Бездействие"?

- Причины Алгоритмического Бездействия

- Примеры Алгоритмического Бездействия в Реальной Жизни

- Последствия Алгоритмического Бездействия

- Как Предотвратить Алгоритмическое Бездействие

- Роль Человека в Мире ИИ

- Будущее Алгоритмической Ответственности

ИИ и Проблема "Алгоритмического Бездействия": Когда Машина Молчит

Приветствую вас, дорогие читатели! Сегодня мы погрузимся в захватывающую и, признаться, немного пугающую тему: "алгоритмическое бездействие". Это явление, когда наши умные машины, напичканные искусственным интеллектом, вдруг… молчат. Не выдают рекомендации, не принимают решения, не предупреждают об опасностях. Казалось бы, в век автоматизации и тотальной цифровизации, когда ИИ проникает во все сферы нашей жизни, такое поведение звучит как фантастика. Но, поверьте, это реальность, с которой нам придется столкнуться.

Мы, как пользователи и наблюдатели, часто воспринимаем ИИ как некую волшебную палочку, способную решить любые проблемы. Мы ожидаем, что он будет всегда на страже, всегда готов предложить оптимальное решение, всегда предупредит о возможных рисках. Но что происходит, когда эта палочка молчит? Когда алгоритм, который должен был нас защитить, внезапно перестает работать? Давайте разбираться.

Что такое "Алгоритмическое Бездействие"?

"Алгоритмическое бездействие" – это ситуация, когда алгоритм, предназначенный для выполнения определенной задачи (например, выявления мошеннических операций, предоставления медицинских рекомендаций или управления транспортным потоком), не предпринимает никаких действий в ситуации, когда должен был это сделать. Это может произойти по разным причинам: от ошибок в коде до недостаточной подготовки данных или намеренного саботажа.

Представьте себе систему автоматического управления автомобилем. Она должна реагировать на изменение дорожной обстановки, избегать столкновений и поддерживать безопасную скорость. Но что, если в какой-то момент алгоритм "зависнет" и перестанет реагировать на препятствия? Последствия могут быть катастрофическими. Или, например, система, которая должна выявлять подозрительные транзакции в банке, вдруг перестает работать. Это может привести к огромным финансовым потерям.

Причины Алгоритмического Бездействия

Существует множество факторов, которые могут привести к алгоритмическому бездействию. Вот некоторые из наиболее распространенных:

- Ошибки в коде: Банальные ошибки программирования, которые могут привести к сбоям в работе алгоритма.

- Недостаточная подготовка данных: Если алгоритм обучался на неполных или нерелевантных данных, он может не распознать определенные ситуации и не предпринять необходимых действий.

- Смещение данных: Если данные, на которых обучался алгоритм, содержат предвзятости или дискриминационные элементы, он может принимать несправедливые или дискриминационные решения.

- Атака злоумышленников: Злоумышленники могут намеренно вывести алгоритм из строя, чтобы получить выгоду или нанести ущерб.

- Непредвиденные обстоятельства: Алгоритм может столкнуться с ситуацией, которая не была предусмотрена разработчиками, и не знать, как на нее реагировать.

Примеры Алгоритмического Бездействия в Реальной Жизни

К сожалению, случаи алгоритмического бездействия уже происходят в реальной жизни. Вот несколько примеров:

- Система автоматического управления автомобилем не распознала пешехода и не затормозила вовремя, что привело к ДТП.

- Алгоритм, используемый для оценки кредитоспособности заемщиков, отклонил заявку на кредит женщине, несмотря на ее высокую зарплату и хорошую кредитную историю. Оказалось, что алгоритм был предвзят по отношению к женщинам.

- Система мониторинга социальных сетей не обнаружила признаки подготовки к теракту, что позволило злоумышленникам совершить преступление.

"Технологии – это всего лишь инструмент. Важно не то, что мы делаем с технологиями, а то, как технологии меняют нас." ౼ Николас Карр

Последствия Алгоритмического Бездействия

Последствия алгоритмического бездействия могут быть самыми разными: от незначительных неудобств до серьезных трагедий. Вот некоторые из наиболее распространенных последствий:

- Финансовые потери: Алгоритмическое бездействие может привести к убыткам для компаний, инвесторов и отдельных лиц.

- Репутационные риски: Если алгоритм принимает несправедливые или дискриминационные решения, это может нанести ущерб репутации компании.

- Угроза безопасности: В критических системах, таких как системы управления транспортом или медицинское оборудование, алгоритмическое бездействие может привести к травмам или смерти.

- Потеря доверия: Если люди перестанут доверять алгоритмам, они будут менее охотно использовать их, что замедлит развитие технологий.

Как Предотвратить Алгоритмическое Бездействие

Предотвращение алгоритмического бездействия – это сложная и многогранная задача. Она требует комплексного подхода, включающего в себя следующие меры:

- Тщательное тестирование: Алгоритмы должны быть тщательно протестированы на различных сценариях, чтобы выявить возможные ошибки и недостатки.

- Использование качественных данных: Алгоритмы должны обучаться на полных, релевантных и непредвзятых данных.

- Мониторинг производительности: Необходимо постоянно отслеживать работу алгоритмов, чтобы выявлять отклонения от нормы и оперативно реагировать на возникающие проблемы.

- Разработка резервных систем: В критических системах необходимо иметь резервные системы, которые могут взять на себя управление в случае отказа основного алгоритма.

- Обучение пользователей: Пользователи должны быть обучены тому, как распознавать признаки алгоритмического бездействия и как действовать в таких ситуациях.

- Регулярное обновление: Алгоритмы должны регулярно обновляться, чтобы учитывать новые данные и устранять выявленные ошибки.

- Прозрачность и объяснимость: Необходимо стремиться к тому, чтобы алгоритмы были прозрачными и объяснимыми, чтобы люди могли понимать, как они работают и почему они принимают те или иные решения.

Роль Человека в Мире ИИ

В эпоху развития искусственного интеллекта, роль человека не уменьшается, а наоборот, становится еще более важной. Мы должны быть готовы к тому, что алгоритмы не всегда будут работать идеально, и нам придется брать на себя ответственность за принятие решений в сложных ситуациях; Мы должны быть критически настроены по отношению к ИИ, понимать его ограничения и не бояться вмешиваться, когда он ошибается.

Нам необходимо развивать навыки критического мышления, аналитические способности и умение принимать решения в условиях неопределенности. Мы должны быть готовы к тому, что мир вокруг нас будет постоянно меняться, и нам придется адаптироваться к новым вызовам и возможностям.

Искусственный интеллект – это мощный инструмент, который может принести огромную пользу человечеству. Но, как и любой инструмент, он может быть использован во благо или во вред. Все зависит от нас, от нашего выбора и от нашей ответственности.

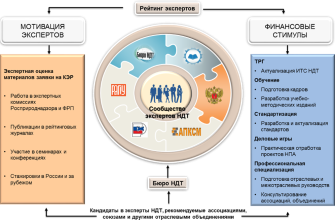

Будущее Алгоритмической Ответственности

В будущем, вопросы алгоритмической ответственности будут становиться все более актуальными. Нам необходимо разработать четкие правила и стандарты, которые будут регулировать использование ИИ в различных сферах жизни. Нам необходимо создать механизмы, которые позволят привлекать к ответственности разработчиков и пользователей алгоритмов за их действия.

Нам необходимо развивать образование и просвещение в области ИИ, чтобы люди могли понимать, как работают алгоритмы и какие риски связаны с их использованием. Нам необходимо создать открытую и прозрачную систему разработки и использования ИИ, чтобы люди могли контролировать этот процесс и влиять на принимаемые решения.

Будущее ИИ – это будущее, которое мы создаем сами. И от того, насколько ответственно и осознанно мы будем подходить к этому процессу, зависит то, каким будет этот мир.

Подробнее

| Алгоритмическая предвзятость | Этика искусственного интеллекта | Безопасность ИИ | Прозрачность алгоритмов | Ответственность за ИИ |

|---|---|---|---|---|

| Обучение ИИ | Тестирование алгоритмов | Мониторинг ИИ | Управление рисками ИИ | Влияние ИИ на общество |

Точка.