ИИ и Проблема Алгоритмического Бездействия: Когда Умная Машина Молчит

Мы, как люди, живущие в эпоху стремительного развития искусственного интеллекта, часто задаемся вопросом: чего ожидать от этих умных машин? Нам обещают революцию во всех сферах жизни, от медицины до транспорта. Но что происходит, когда ИИ не просто ошибается, а… бездействует? Когда алгоритм, призванный помогать, молчит в самый ответственный момент? Это и есть проблема алгоритмического бездействия, и сегодня мы погрузимся в ее суть, рассмотрим примеры и попытаемся понять, как с этим бороться.

Мы видим, как ИИ проникает в нашу жизнь всё глубже. Он советует нам фильмы, подбирает музыку, оптимизирует маршруты. Мы доверяем ему всё больше задач, полагаясь на его способность анализировать огромные объемы данных и принимать рациональные решения. Но что, если эта способность вдруг исчезает? Что, если ИИ, который должен был нас защитить, внезапно отключается, оставляя нас один на один с проблемой?

Что такое Алгоритмическое Бездействие?

Алгоритмическое бездействие – это ситуация, когда система искусственного интеллекта не предпринимает никаких действий в ситуации, требующей вмешательства. Это может происходить по разным причинам: от ошибок в коде и нехватки данных до намеренного ограничения функциональности. Важно понимать, что бездействие не всегда является ошибкой. Иногда оно может быть запрограммировано, например, для предотвращения нежелательных последствий.

Однако чаще всего бездействие является следствием недостатков в разработке или обучении ИИ. Алгоритм может быть не обучен распознавать определенные ситуации, или он может быть слишком чувствителен к ложным срабатываниям, что приводит к его отключению в критический момент. В любом случае, последствия алгоритмического бездействия могут быть очень серьезными.

Причины Алгоритмического Бездействия

Чтобы понять, как бороться с этой проблемой, необходимо разобраться в её причинах. Мы выделили несколько основных факторов, способствующих алгоритмическому бездействию:

- Недостаток данных: ИИ, обученный на неполных или предвзятых данных, может не распознавать определенные ситуации или принимать неправильные решения.

- Сложность алгоритма: Слишком сложный алгоритм может быть подвержен ошибкам и сбоям, что приводит к его отключению.

- Ограничения функциональности: Намеренное ограничение функциональности ИИ для предотвращения нежелательных последствий;

- Недостаточное тестирование: Недостаточное тестирование ИИ в различных сценариях может привести к тому, что ошибки и недостатки не будут выявлены вовремя.

- Этические соображения: В некоторых случаях, ИИ может быть запрограммирован на бездействие из этических соображений, например, чтобы избежать причинения вреда человеку.

Примеры Алгоритмического Бездействия

Давайте рассмотрим несколько конкретных примеров, чтобы лучше понять, как проявляется алгоритмическое бездействие в реальной жизни:

- Автопилот автомобиля: Система автопилота может отключиться в сложной дорожной ситуации, требуя немедленного вмешательства водителя. Если водитель не готов к этому, это может привести к аварии.

- Система мониторинга здоровья: Система мониторинга здоровья может не распознать признаки ухудшения состояния пациента, что приведет к задержке оказания медицинской помощи.

- Система обнаружения мошенничества: Система обнаружения мошенничества может не заметить подозрительную транзакцию, что приведет к финансовым потерям.

- Система безопасности: Система безопасности может не отреагировать на вторжение, что поставит под угрозу жизни людей.

Эти примеры показывают, что алгоритмическое бездействие может иметь серьезные последствия в различных областях жизни. Важно понимать, что ИИ не является панацеей, и он может быть подвержен ошибкам и сбоям. Поэтому необходимо принимать меры для предотвращения алгоритмического бездействия и смягчения его последствий.

"Искусственный интеллект не заменит вас, но люди, использующие искусственный интеллект, заменят вас." ⎼ Том Девенпорт

Как Бороться с Алгоритмическим Бездействием?

Борьба с алгоритмическим бездействием – это сложная задача, требующая комплексного подхода. Мы предлагаем несколько стратегий, которые могут помочь в решении этой проблемы:

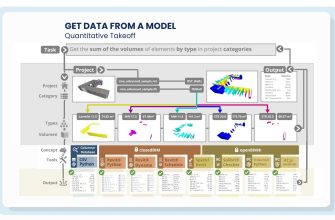

- Улучшение качества данных: Необходимо использовать полные, репрезентативные и непредвзятые данные для обучения ИИ. Важно также учитывать различные сценарии и крайние случаи.

- Разработка более надежных алгоритмов: Необходимо разрабатывать алгоритмы, устойчивые к ошибкам и сбоям. Важно также предусмотреть механизмы резервирования и восстановления.

- Тщательное тестирование: Необходимо тщательно тестировать ИИ в различных сценариях, чтобы выявить ошибки и недостатки. Важно также проводить стресс-тестирование для оценки устойчивости системы к экстремальным условиям.

- Разработка механизмов контроля: Необходимо разработать механизмы контроля, которые позволят человеку вмешиваться в работу ИИ в случае необходимости. Важно также предусмотреть возможность отмены решений, принятых ИИ.

- Обучение пользователей: Необходимо обучать пользователей правильно взаимодействовать с ИИ и понимать его ограничения. Важно также научить пользователей распознавать ситуации, когда ИИ может бездействовать, и принимать соответствующие меры.

Нам кажется, что важно понимать, что ИИ – это инструмент, а не замена человеческому разуму. Он может помочь нам решать сложные задачи, но он не должен полностью заменять нас. Мы должны оставаться бдительными и критически оценивать решения, принимаемые ИИ, чтобы избежать негативных последствий.

Этические Аспекты Алгоритмического Бездействия

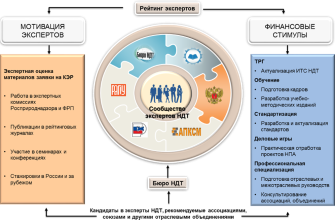

Проблема алгоритмического бездействия имеет не только технические, но и этические аспекты. Кто несет ответственность за последствия бездействия ИИ? Разработчики, производители, пользователи? Этот вопрос требует серьезного обсуждения и разработки четких правил и норм.

Мы считаем, что необходимо разработать этические принципы использования ИИ, которые будут учитывать возможность алгоритмического бездействия и предусматривать меры по смягчению его последствий. Важно также обеспечить прозрачность и подотчетность в разработке и использовании ИИ, чтобы пользователи могли понимать, как работает система и какие риски с ней связаны.

Алгоритмическое бездействие – это серьезная проблема, которая может иметь негативные последствия в различных областях жизни. Мы должны осознавать эту проблему и принимать меры для её решения. Улучшение качества данных, разработка более надежных алгоритмов, тщательное тестирование, разработка механизмов контроля и обучение пользователей – это лишь некоторые из стратегий, которые могут помочь в борьбе с алгоритмическим бездействием.

Нам важно помнить, что ИИ – это мощный инструмент, который может принести огромную пользу человечеству. Но, как и любой инструмент, он может быть использован неправильно. Поэтому мы должны быть бдительными и ответственными в разработке и использовании ИИ, чтобы избежать негативных последствий, в т.ч. и алгоритмического бездействия. Наше будущее зависит от того, как мы будем использовать эти умные машины.

Подробнее

| Влияние ИИ на безопасность | Этика алгоритмического бездействия | Риски автоматизации | Ответственность за ошибки ИИ | Примеры бездействия автопилота |

|---|---|---|---|---|

| Проблемы обучения ИИ | Недостатки алгоритмов | Тестирование ИИ систем | Контроль над ИИ | Обучение пользователей ИИ |