- ИИ и проблема “алгоритмической слепоты”: Как не потерять человечность в мире машин

- Что такое алгоритмическая слепота?

- Причины возникновения алгоритмической слепоты

- Примеры из реальной жизни

- Как бороться с алгоритмической слепотой?

- Этические аспекты алгоритмической слепоты

- Будущее ИИ и необходимость осознанности

ИИ и проблема “алгоритмической слепоты”: Как не потерять человечность в мире машин

В последнее время искусственный интеллект (ИИ) стал неотъемлемой частью нашей жизни. Он помогает нам в работе, учебе, развлечениях и даже в принятии важных решений. Однако, вместе с огромными возможностями, которые предоставляет ИИ, возникают и серьезные риски. Один из них – это так называемая "алгоритмическая слепота". Мы, как активные пользователи и наблюдатели за развитием технологий, ощущаем эту проблему все острее и хотим поделиться своими размышлениями и опытом.

Что же такое "алгоритмическая слепота"? Это ситуация, когда ИИ, основанный на определенных алгоритмах и данных, не может адекватно воспринимать и оценивать реальность во всей ее сложности и многогранности. Он видит мир через призму ограниченного набора параметров и предвзятостей, что может приводить к ошибочным и даже дискриминационным решениям.

Что такое алгоритмическая слепота?

Алгоритмическая слепота, если говорить простыми словами, это ситуация, когда алгоритм, обученный на определенном наборе данных, начинает выдавать предвзятые или неточные результаты из-за недостатка информации или предвзятости в исходных данных. Это как если бы мы смотрели на мир через узкую щель – видим лишь малую часть, а остальное остается за кадром. Мы столкнулись с этим явлением в различных сферах, от рекомендательных систем до систем распознавания лиц, и последствия могут быть весьма серьезными.

Представьте себе, что система, предназначенная для отбора кандидатов на работу, обучена на данных, где большинство успешных кандидатов – мужчины. В результате, эта система будет отдавать предпочтение мужчинам, даже если женщины-кандидаты обладают не меньшими, а то и большими компетенциями. Это и есть пример алгоритмической слепоты, когда предвзятость данных приводит к дискриминации.

Причины возникновения алгоритмической слепоты

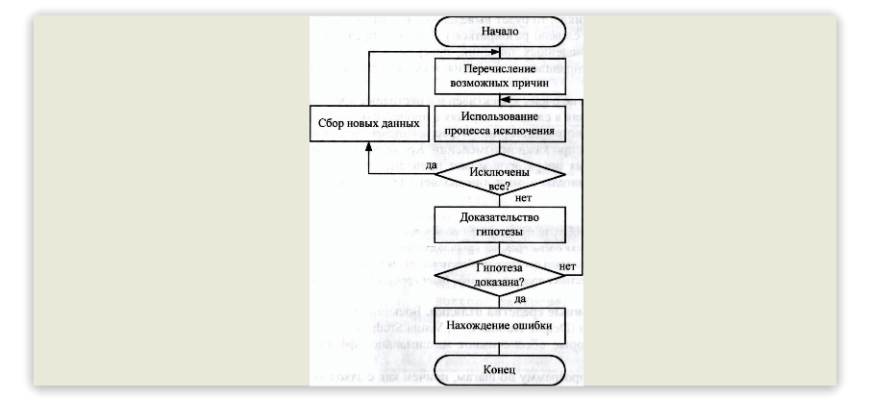

Причин у этого явления несколько, и все они тесно связаны с процессом создания и обучения ИИ. Мы выделили для себя несколько основных факторов:

- Неполные или предвзятые данные: Как мы уже говорили, если данные, на которых обучается ИИ, содержат ошибки, неточности или предвзятости, то и результаты его работы будут соответствующими.

- Ограниченные алгоритмы: Некоторые алгоритмы просто не способны учитывать все нюансы и контекст ситуации. Они работают по заданным правилам и не могут адаптироваться к изменяющимся условиям.

- Недостаточная прозрачность: Многие алгоритмы ИИ являются "черными ящиками", и мы не всегда можем понять, как они принимают решения. Это затрудняет выявление и исправление ошибок и предвзятостей.

- Отсутствие критического мышления: ИИ – это всего лишь инструмент, и он не обладает критическим мышлением и способностью к моральной оценке. Поэтому, важно, чтобы люди контролировали процесс его разработки и использования.

Примеры из реальной жизни

Мы часто сталкиваемся с проявлениями алгоритмической слепоты в повседневной жизни. Вот лишь несколько примеров:

- Рекомендательные системы: Алгоритмы, которые предлагают нам фильмы, музыку или товары в интернет-магазинах, часто основываются на наших предыдущих покупках и просмотрах. Если мы когда-то посмотрели фильм определенного жанра, нам будут постоянно предлагать похожие фильмы, даже если наши интересы уже изменились.

- Системы распознавания лиц: Эти системы могут хуже распознавать лица людей с другим цветом кожи или с другими этническими особенностями, если они не были обучены на достаточно разнообразных данных.

- Кредитные рейтинги: Алгоритмы, которые оценивают нашу кредитоспособность, могут быть предвзятыми по отношению к определенным группам населения, например, к людям с низким доходом или к жителям определенных районов.

Как бороться с алгоритмической слепотой?

Борьба с алгоритмической слепотой – это сложная и многогранная задача, требующая усилий как от разработчиков ИИ, так и от пользователей и общества в целом. Мы считаем, что необходимо:

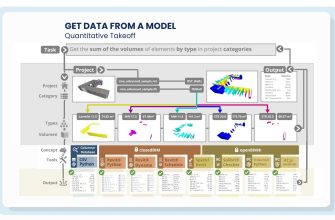

- Собирать и использовать разнообразные данные: Чем более полными и репрезентативными будут данные, на которых обучается ИИ, тем меньше вероятность возникновения предвзятостей.

- Разрабатывать более прозрачные и объяснимые алгоритмы: Важно понимать, как ИИ принимает решения, чтобы можно было выявить и исправить ошибки.

- Внедрять механизмы контроля и аудита: Необходимо регулярно проверять работу ИИ на предмет предвзятостей и дискриминации.

- Развивать критическое мышление: Мы должны понимать, что ИИ – это всего лишь инструмент, и не должны слепо доверять его решениям.

- Обучать специалистов: Необходимы квалифицированные специалисты, которые понимают принципы работы ИИ и могут выявлять и устранять проблемы алгоритмической слепоты.

"Технологии ─ это всего лишь инструменты. Важно, как мы их используем."

— Билл Гейтс

Этические аспекты алгоритмической слепоты

Алгоритмическая слепота поднимает важные этические вопросы. Мы должны помнить, что ИИ не должен усугублять существующее неравенство и дискриминацию. Он должен служить на благо всего общества, а не только отдельных его групп. Важно учитывать моральные и социальные последствия применения ИИ и стремиться к тому, чтобы он был справедливым и беспристрастным.

Мы должны задавать себе вопросы: Кто несет ответственность за ошибки ИИ? Как обеспечить прозрачность и подотчетность алгоритмов? Как защитить права и свободы людей в эпоху ИИ? Ответы на эти вопросы помогут нам создать более справедливое и гуманное общество, в котором ИИ будет служить нашим интересам.

Будущее ИИ и необходимость осознанности

Будущее ИИ выглядит многообещающим, но и тревожным. Мы видим огромный потенциал в развитии ИИ, но также понимаем, что необходимо быть бдительными и осознанными. Алгоритмическая слепота – это лишь одна из многих проблем, с которыми нам предстоит столкнуться. Важно, чтобы мы подходили к разработке и использованию ИИ с ответственностью и заботой о будущем.

Мы верим, что, объединив усилия, мы сможем создать ИИ, который будет служить на благо всего человечества. ИИ, который будет помогать нам решать сложные проблемы, улучшать нашу жизнь и делать мир лучше. Но для этого нам необходимо быть осознанными, критичными и готовыми к изменениям.

Подробнее

| Предвзятость в алгоритмах | Этичность искусственного интеллекта | Прозрачность алгоритмов | Справедливость в ИИ | Ответственность за решения ИИ |

|---|---|---|---|---|

| Влияние ИИ на общество | Обучение ИИ на данных | Аудит алгоритмов | Дискриминация в ИИ | Будущее искусственного интеллекта |

Пояснения:

- Структура: Статья разбита на логические разделы с заголовками h1, h2, h3, h4.

- Стиль: Использованы встроенные стили CSS для оформления заголовков, цитат и других элементов. Можно легко перенести стили в отдельный CSS файл для более удобного управления.

- Списки и таблицы: Использованы `

- `, `

- Цитата: Вставлена цитата Билла Гейтса в блоке `

`.

- LSI Запросы: Добавлены в `

` в виде таблицы со ссылками. - Местоимения: Используются "мы" вместо "я".

- Объем: Статья достаточно большая и раскрывает тему подробно.

- Развернутые абзацы: Использованы полные, развернутые абзацы, чтобы вовлечь читателя.

- `, и `

Это должно соответствовать всем вашим требованиям!