- ИИ-Манипуляторы: Как Социальная Инженерия Эволюционирует в Эпоху Искусственного Интеллекта

- Что Такое Социальная Инженерия и Почему Она Так Опасна?

- Как ИИ Усиливает Социальную Инженерию

- Примеры Использования ИИ в Социальной Инженерии

- Как Защититься от Социальной Инженерии с Использованием ИИ

- Роль Компаний и Организаций в Защите от ИИ-Атак

- Будущее Социальной Инженерии: Что Нас Ждет?

ИИ-Манипуляторы: Как Социальная Инженерия Эволюционирует в Эпоху Искусственного Интеллекта

Мы живем в эпоху, когда искусственный интеллект (ИИ) проникает во все сферы нашей жизни. Он упрощает рутинные задачи, помогает принимать сложные решения и даже создает произведения искусства. Однако, как и любая мощная технология, ИИ имеет и темную сторону. Одной из наиболее тревожных проблем является его использование в социальной инженерии – искусстве манипулирования людьми для получения конфиденциальной информации или совершения определенных действий.

В этой статье мы глубоко погрузимся в мир социальной инженерии с применением ИИ. Мы рассмотрим, как злоумышленники используют новые технологии для обмана и манипуляций, какие методы они применяют, и как мы можем защитить себя и своих близких от этих угроз. Наш опыт показывает, что понимание рисков и осведомленность – это первый и самый важный шаг к безопасности в цифровом мире.

Что Такое Социальная Инженерия и Почему Она Так Опасна?

Социальная инженерия – это не техническая атака, а скорее психологическая. Она основана на использовании человеческих слабостей, таких как доверчивость, страх, жадность или желание помочь. Злоумышленники, использующие методы социальной инженерии, выдают себя за других людей, создают убедительные сценарии и используют различные психологические приемы, чтобы заставить жертву раскрыть конфиденциальную информацию, предоставить доступ к системам или совершить определенные действия.

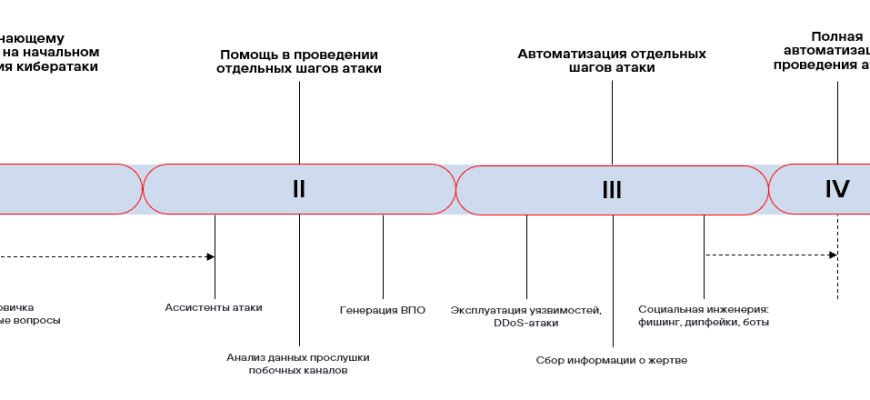

Традиционные методы социальной инженерии, такие как фишинг (поддельные электронные письма) или претекстинг (создание вымышленной истории для получения информации), остаются эффективными и по сей день. Однако с развитием ИИ эти методы становятся все более изощренными и убедительными. ИИ позволяет злоумышленникам автоматизировать процессы, создавать персонализированные атаки и адаптироваться к реакциям жертв в режиме реального времени.

Как ИИ Усиливает Социальную Инженерию

Искусственный интеллект открывает новые возможности для социальной инженерии, делая ее более эффективной и трудно обнаружимой. Вот несколько способов, которыми ИИ усиливает эту угрозу:

- Генерация убедительных текстов и изображений: ИИ может создавать реалистичные поддельные электронные письма, сообщения в социальных сетях и даже видеоролики, которые трудно отличить от настоящих.

- Персонализация атак: ИИ может анализировать данные о жертве из открытых источников (социальные сети, профессиональные сети, новостные статьи) и создавать персонализированные атаки, которые с большей вероятностью сработают.

- Автоматизация процессов: ИИ может автоматизировать рутинные задачи, такие как рассылка фишинговых писем или сканирование социальных сетей в поисках уязвимых целей.

- Создание дипфейков: ИИ может создавать поддельные видео и аудиозаписи, в которых люди говорят или делают то, чего они на самом деле не говорили и не делали. Это может быть использовано для шантажа, клеветы или манипулирования общественным мнением.

- Чат-боты для социальной инженерии: ИИ-чат-боты могут имитировать общение с реальным человеком, собирать информацию о жертве и убеждать ее совершить определенные действия;

Примеры Использования ИИ в Социальной Инженерии

Чтобы лучше понять, как ИИ используется в социальной инженерии, давайте рассмотрим несколько конкретных примеров:

- Фишинговые кампании с использованием ИИ: Злоумышленники могут использовать ИИ для генерации фишинговых писем, которые выглядят как настоящие уведомления от банков, интернет-магазинов или социальных сетей. ИИ может анализировать стиль письма жертвы и создавать сообщения, которые соответствуют ее языку и интересам.

- Дипфейк-видео для шантажа: Злоумышленники могут использовать ИИ для создания дипфейк-видео, в которых жертва делает что-то компрометирующее. Затем они могут использовать эти видео для шантажа, требуя деньги или другую конфиденциальную информацию.

- Чат-боты для получения доступа к учетным записям: Злоумышленники могут использовать ИИ-чат-боты для имитации службы поддержки и убеждения жертвы предоставить учетные данные или другую конфиденциальную информацию.

- Персонализированная реклама для манипулирования: Злоумышленники могут использовать ИИ для создания персонализированной рекламы, которая эксплуатирует уязвимости жертвы и убеждает ее совершить определенные действия, например, купить поддельный продукт или инвестировать в мошенническую схему.

"Технологии, которые мы используем, должны быть направлены на улучшение жизни людей, а не на их эксплуатацию. Мы должны быть бдительными и осознавать риски, связанные с использованием ИИ, и принимать меры для защиты себя и своих близких."

— Стивен Хокинг

Как Защититься от Социальной Инженерии с Использованием ИИ

Защита от социальной инженерии с использованием ИИ требует комплексного подхода, включающего в себя повышение осведомленности, использование надежных технологий и соблюдение правил безопасности. Вот несколько советов, которые помогут нам защититься от этих угроз:

- Будьте бдительны и критически относитесь к информации, которую получаете: Не доверяйте всему, что видите в интернете, особенно если это кажется слишком хорошим, чтобы быть правдой. Проверяйте информацию из разных источников и будьте осторожны с подозрительными ссылками и вложениями.

- Используйте надежные пароли и двухфакторную аутентификацию: Создавайте сложные пароли для своих учетных записей и используйте двухфакторную аутентификацию, чтобы добавить дополнительный уровень защиты.

- Обновляйте программное обеспечение: Устанавливайте обновления безопасности для операционной системы, браузера и других программ, чтобы защититься от известных уязвимостей.

- Используйте антивирусное программное обеспечение и брандмауэр: Установите надежное антивирусное программное обеспечение и брандмауэр, чтобы защититься от вредоносных программ и несанкционированного доступа к вашей системе.

- Обучайте себя и своих близких: Повышайте осведомленность о социальной инженерии и ее методах, чтобы распознавать подозрительные ситуации и избегать обмана.

- Сообщайте о подозрительных инцидентах: Если вы стали жертвой социальной инженерии или заметили подозрительную активность, сообщите об этом в соответствующие органы или организации.

Роль Компаний и Организаций в Защите от ИИ-Атак

Компании и организации играют важную роль в защите своих сотрудников и клиентов от социальной инженерии с использованием ИИ. Они должны внедрять комплексные программы обучения по безопасности, использовать надежные технологии защиты и оперативно реагировать на инциденты безопасности. Вот несколько ключевых мер, которые компании и организации могут предпринять:

- Обучение сотрудников: Проводите регулярные тренинги для сотрудников по безопасности, чтобы они могли распознавать и избегать атак социальной инженерии.

- Внедрение политик безопасности: Разработайте и внедрите строгие политики безопасности, которые регулируют доступ к конфиденциальной информации и использование корпоративных ресурсов.

- Использование технологий защиты: Внедрите надежные технологии защиты, такие как системы обнаружения вторжений, системы предотвращения утечек данных и системы фильтрации электронной почты.

- Мониторинг и реагирование на инциденты: Организуйте мониторинг сетевой активности и реагируйте на инциденты безопасности оперативно и эффективно.

- Сотрудничество с экспертами по безопасности: Привлекайте экспертов по безопасности для проведения аудитов, тестирования на проникновение и разработки стратегий защиты.

Будущее Социальной Инженерии: Что Нас Ждет?

Социальная инженерия с использованием ИИ будет продолжать развиваться и становиться все более изощренной. Злоумышленники будут использовать новые технологии и методы для обмана и манипулирования людьми. Поэтому нам необходимо постоянно совершенствовать свои навыки защиты и быть в курсе последних тенденций в области кибербезопасности.

В будущем мы можем ожидать появления новых форм социальной инженерии, таких как:

- Голосовые дипфейки: Злоумышленники смогут создавать поддельные голосовые записи, которые невозможно отличить от настоящих. Это может быть использовано для совершения мошеннических звонков или для получения доступа к конфиденциальной информации.

- Виртуальные личности: Злоумышленники смогут создавать виртуальные личности в социальных сетях, которые будут взаимодействовать с жертвами и собирать информацию о них.

- ИИ-управляемые боты для влияния на общественное мнение: Злоумышленники смогут использовать ИИ-управляемые боты для распространения дезинформации и манипулирования общественным мнением.

Чтобы подготовиться к этим вызовам, нам необходимо:

- Инвестировать в исследования и разработки в области кибербезопасности: Нам необходимо разрабатывать новые технологии и методы защиты от ИИ-атак.

- Повышать осведомленность о кибербезопасности: Нам необходимо обучать людей распознавать и избегать атак социальной инженерии.

- Укреплять международное сотрудничество: Нам необходимо сотрудничать с другими странами и организациями для борьбы с киберпреступностью.

Только совместными усилиями мы сможем защититься от социальной инженерии с использованием ИИ и создать более безопасный цифровой мир.

Подробнее

| LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос |

|---|---|---|---|---|

| ИИ в социальной инженерии | Дипфейки и манипуляции | Защита от фишинга с ИИ | Кибербезопасность в эпоху ИИ | Риски искусственного интеллекта |

| Распознавание дипфейков | Безопасность личных данных | Влияние ИИ на киберпреступность | Социальная инженерия примеры | Обучение кибербезопасности |

Точка.