- ИИ ослеп? Как "Алгоритмическая Слепота" Подрывает Доверие к Искусственному Интеллекту

- Что такое "Алгоритмическая Слепота" и почему это важно?

- Причины возникновения "Алгоритмической Слепоты"

- Предвзятые Данные

- Ограниченные Данные

- Неправильный Выбор Алгоритма

- Неправильная Настройка Параметров Алгоритма

- Отсутствие Прозрачности

- Последствия "Алгоритмической Слепоты"

- Как бороться с "Алгоритмической Слепотой"?

- Сбор и анализ данных

- Разработка и использование "справедливых" алгоритмов

- Прозрачность и объяснимость алгоритмов

- Аудит и мониторинг алгоритмов

- Обучение и повышение осведомленности

- Практические примеры борьбы с "Алгоритмической Слепотой"

- Будущее ИИ и "Алгоритмическая Слепота"

ИИ ослеп? Как "Алгоритмическая Слепота" Подрывает Доверие к Искусственному Интеллекту

Мы живем в эпоху, когда искусственный интеллект (ИИ) проникает во все сферы нашей жизни. От рекомендаций фильмов до медицинских диагнозов, алгоритмы принимают решения, которые оказывают огромное влияние на нас. Но что происходит, когда эти алгоритмы "слепнут"? Когда они начинают выдавать предвзятые, несправедливые или просто ошибочные результаты? Мы столкнулись с явлением, которое получило название "алгоритмическая слепота", и оно представляет собой серьезную угрозу для будущего ИИ.

В этой статье мы, как энтузиасты и исследователи мира ИИ, рассмотрим эту проблему во всех ее аспектах. Мы разберемся в причинах возникновения "алгоритмической слепоты", изучим ее последствия и, самое главное, предложим пути решения. Приготовьтесь к глубокому погружению в мир предвзятых алгоритмов и поиску способов сделать ИИ более справедливым и прозрачным.

Что такое "Алгоритмическая Слепота" и почему это важно?

"Алгоритмическая слепота" – это метафора, описывающая ситуацию, когда алгоритмы ИИ, в силу различных причин, не способны адекватно воспринимать и обрабатывать информацию, что приводит к ошибочным или предвзятым результатам. Это может проявляться в дискриминации определенных групп людей, неверных прогнозах или просто в нелогичных решениях; Важность этой проблемы трудно переоценить, ведь ИИ все чаще используется в критически важных областях, таких как здравоохранение, образование, правосудие и финансы.

Представьте себе систему, которая автоматически отбирает кандидатов на работу. Если эта система обучена на данных, которые исторически отражают гендерные или расовые предубеждения, она может неосознанно дискриминировать определенные группы соискателей. Это не только несправедливо, но и лишает компанию возможности нанять лучших специалистов. Или представьте себе алгоритм, который определяет кредитный рейтинг человека. Если этот алгоритм предвзят по отношению к определенным районам города, он может лишить людей возможности получить кредит на жилье или образование. Эти примеры показывают, что "алгоритмическая слепота" может иметь серьезные социальные и экономические последствия.

Причины возникновения "Алгоритмической Слепоты"

Существует несколько основных причин, по которым алгоритмы ИИ могут "ослепнуть":

Предвзятые Данные

Это, пожалуй, самая распространенная причина "алгоритмической слепоты". Алгоритмы ИИ обучаются на данных, и если эти данные отражают существующие в обществе предубеждения, алгоритм неизбежно унаследует эти предубеждения. Например, если алгоритм распознавания лиц обучен преимущественно на фотографиях людей с определенным цветом кожи, он может хуже распознавать лица людей с другим цветом кожи.

Ограниченные Данные

Если алгоритм обучается на недостаточном или нерепрезентативном объеме данных, он может не учитывать важные факторы и закономерности. Например, если алгоритм прогнозирования заболеваний обучается только на данных о мужчинах, он может давать неточные прогнозы для женщин.

Неправильный Выбор Алгоритма

Некоторые алгоритмы лучше подходят для решения определенных задач, чем другие. Если выбрать неподходящий алгоритм, он может не учитывать важные особенности данных и давать неточные результаты. Например, для обработки текстовых данных лучше использовать алгоритмы, специально разработанные для этой цели, а не универсальные алгоритмы машинного обучения.

Неправильная Настройка Параметров Алгоритма

Большинство алгоритмов ИИ имеют множество параметров, которые необходимо настроить для достижения оптимальной производительности. Если эти параметры настроены неправильно, алгоритм может давать неточные или предвзятые результаты. Например, если установить слишком высокий порог чувствительности для алгоритма обнаружения мошеннических транзакций, он может ложно обвинять невиновных людей.

Отсутствие Прозрачности

Многие современные алгоритмы ИИ, особенно так называемые "черные ящики", очень сложны и непрозрачны. Трудно понять, как именно они принимают решения, что затрудняет выявление и исправление ошибок и предубеждений. Это особенно проблематично в областях, где решения ИИ могут иметь серьезные последствия, таких как правосудие и здравоохранение.

"Искусственный интеллект ౼ это зеркало, отражающее наши собственные предубеждения. Если мы хотим, чтобы он был справедливым, мы должны сначала стать справедливыми сами."

౼ Кэти О’Нил, автор книги "Оружие математического уничтожения"

Последствия "Алгоритмической Слепоты"

Последствия "алгоритмической слепоты" могут быть весьма серьезными и разнообразными. Вот лишь некоторые из них:

- Дискриминация: Алгоритмы могут дискриминировать определенные группы людей по признаку расы, пола, возраста, религии, сексуальной ориентации и другим признакам.

- Несправедливость: Алгоритмы могут принимать несправедливые решения, которые лишают людей возможностей или наносят им ущерб.

- Утрата доверия: Если люди перестают доверять алгоритмам, они могут отказаться от их использования, что замедлит развитие и внедрение ИИ.

- Усиление неравенства: "Алгоритмическая слепота" может усугубить существующее в обществе неравенство, создавая замкнутый круг, в котором предвзятые алгоритмы воспроизводят и усиливают предубеждения.

- Ошибочные решения: Алгоритмы могут принимать ошибочные решения, которые приводят к негативным последствиям в различных областях, таких как здравоохранение, образование, финансы и правосудие.

Как бороться с "Алгоритмической Слепотой"?

К счастью, существует множество способов бороться с "алгоритмической слепотой". Вот некоторые из наиболее эффективных подходов:

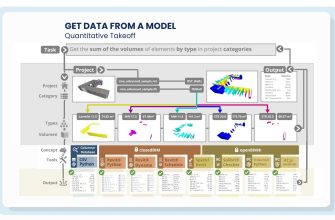

Сбор и анализ данных

Необходимо собирать данные, которые являются репрезентативными для всех групп населения, и тщательно анализировать их на предмет предвзятости. Важно убедиться, что данные отражают реальное положение вещей, а не устаревшие стереотипы или предубеждения.

Разработка и использование "справедливых" алгоритмов

Необходимо разрабатывать и использовать алгоритмы, которые специально разработаны для минимизации предвзятости. Существуют различные методы для достижения этой цели, такие как "adversarial debiasing" и "fairness-aware learning".

Прозрачность и объяснимость алгоритмов

Необходимо стремиться к тому, чтобы алгоритмы были более прозрачными и объяснимыми. Это позволит легче выявлять и исправлять ошибки и предубеждения. Важно понимать, как именно алгоритм принимает решения, и какие факторы влияют на эти решения.

Аудит и мониторинг алгоритмов

Необходимо регулярно проводить аудит и мониторинг алгоритмов, чтобы выявлять и устранять предвзятости. Важно следить за тем, как алгоритмы работают в реальных условиях, и оценивать их влияние на различные группы населения.

Обучение и повышение осведомленности

Необходимо обучать разработчиков, пользователей и общественность в целом о проблеме "алгоритмической слепоты" и способах ее предотвращения. Важно, чтобы все понимали, как алгоритмы работают и какие последствия они могут иметь.

Практические примеры борьбы с "Алгоритмической Слепотой"

Вот несколько примеров того, как компании и организации борются с "алгоритмической слепотой" на практике:

- IBM: Разработала набор инструментов AI Fairness 360 для выявления и устранения предвзятости в алгоритмах ИИ.

- Google: Разработала систему Model Cards для документирования и оценки моделей машинного обучения, включая информацию о их потенциальных предубеждениях.

- Amazon: Приостановила использование алгоритма распознавания лиц Rekognition для правоохранительных органов из-за опасений по поводу его предвзятости.

Будущее ИИ и "Алгоритмическая Слепота"

Будущее ИИ во многом зависит от того, насколько успешно мы сможем справиться с проблемой "алгоритмической слепоты". Если мы сможем разработать и использовать справедливые, прозрачные и объяснимые алгоритмы, ИИ сможет принести огромную пользу обществу. Однако, если мы не сможем этого сделать, "алгоритмическая слепота" может привести к дискриминации, несправедливости и утрате доверия к ИИ.

Мы верим, что с помощью совместных усилий разработчиков, исследователей, политиков и общественности в целом мы сможем построить будущее, в котором ИИ будет использоваться для улучшения жизни всех людей, независимо от их расы, пола, возраста или других признаков.

Подробнее

| LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос |

|---|---|---|---|---|

| Предвзятость в ИИ | Справедливость в алгоритмах | Этика искусственного интеллекта | Прозрачность ИИ | Алгоритмическая дискриминация |

| Последствия предвзятого ИИ | Обучение без предвзятости | AI fairness tools | Как избежать предвзятости в ИИ | Примеры алгоритмической слепоты |