- ИИ в сфере финансов: Этика управления рисками

- Что такое ИИ в финансах и почему это важно?

- Этические вызовы ИИ в управлении рисками

- Примеры этических дилемм

- Как минимизировать этические риски?

- Роль регулирования

- Примеры регуляторных инициатив

- Будущее ИИ в финансах: этический оптимизм

- `‚ ` `‚ ` `‚ ` ` с подчеркиванием и разными цветами для визуального разделения разделов.

- `‚ ` `‚ ` ` с подчеркиванием и разными цветами для визуального разделения разделов.

- `‚ ` ` с подчеркиванием и разными цветами для визуального разделения разделов.

- ` с подчеркиванием и разными цветами для визуального разделения разделов.

ИИ в сфере финансов: Этика управления рисками

Приветствую‚ друзья! Сегодня мы погрузимся в захватывающую и‚ признаться‚ немного пугающую тему: искусственный интеллект в финансах и его этическое измерение‚ особенно в контексте управления рисками. Мы‚ как команда‚ уже несколько лет наблюдаем за развитием этой сферы и пришли к выводу‚ что пора поделиться своими мыслями и опытом. Ведь ИИ уже не просто модное слово‚ а реальный инструмент‚ меняющий финансовый мир прямо сейчас.

Представьте себе: алгоритмы‚ способные анализировать огромные массивы данных за считанные секунды‚ предсказывать рыночные тренды и автоматически принимать решения о покупке и продаже активов. Звучит как научная фантастика? Возможно. Но это уже наша реальность. И вместе с невероятными возможностями приходят и серьезные вопросы: кто несет ответственность за ошибки ИИ? Как обеспечить прозрачность и справедливость алгоритмических решений? И самое главное – как не допустить‚ чтобы технологии‚ призванные нам помогать‚ стали источником новых рисков?

Что такое ИИ в финансах и почему это важно?

Для начала давайте разберемся‚ что мы подразумеваем под ИИ в финансах. Это использование алгоритмов машинного обучения и других технологий ИИ для автоматизации и оптимизации различных финансовых задач. Сюда входит всё: от кредитного скоринга и обнаружения мошеннических операций до управления инвестиционным портфелем и алгоритмической торговли.

Важность этой темы сложно переоценить. Финансовая сфера – это кровеносная система современной экономики. Любые сбои или ошибки в этой системе могут иметь серьезные последствия для миллионов людей. И если раньше риски были связаны с человеческим фактором – некомпетентностью‚ жадностью‚ ошибками в расчетах – то теперь к ним добавляются риски‚ связанные с ИИ: предвзятость алгоритмов‚ ошибки в данных‚ кибератаки и многое другое.

Вот лишь несколько примеров использования ИИ в финансах:

- Кредитный скоринг: Алгоритмы анализируют данные о заемщике (кредитную историю‚ доход‚ место работы и т.д.) и определяют его кредитный рейтинг.

- Обнаружение мошеннических операций: ИИ выявляет подозрительные транзакции‚ которые могут указывать на мошенничество.

- Алгоритмическая торговля: Компьютерные программы автоматически покупают и продают активы на основе заданных параметров.

- Управление инвестиционным портфелем: ИИ помогает инвесторам оптимизировать свои портфели и снижать риски.

Этические вызовы ИИ в управлении рисками

Теперь перейдем к самому интересному – этическим вызовам; Как мы уже говорили‚ ИИ не является нейтральным инструментом. Алгоритмы создаются людьми‚ и они неизбежно несут в себе их предубеждения и ошибки. Это может привести к дискриминации‚ несправедливым решениям и другим негативным последствиям.

Вот некоторые из наиболее важных этических вопросов‚ которые мы должны учитывать:

- Предвзятость алгоритмов: Если данные‚ на которых обучается ИИ‚ содержат предвзятости‚ то алгоритм будет воспроизводить и усиливать эти предвзятости. Например‚ если в исторических данных о кредитах мало информации о женщинах или представителях определенных этнических групп‚ то ИИ может дискриминировать их при выдаче кредитов.

- Непрозрачность алгоритмов: Многие алгоритмы ИИ‚ особенно глубокие нейронные сети‚ являются "черными ящиками". Трудно понять‚ как они принимают решения. Это затрудняет выявление и исправление ошибок и предвзятостей.

- Ответственность за ошибки: Кто несет ответственность за ошибки ИИ? Разработчик алгоритма? Компания‚ которая его использует? Сам ИИ? Этот вопрос пока остается без ответа.

- Конфиденциальность данных: ИИ требует огромных объемов данных для обучения. Сбор и использование этих данных может нарушать конфиденциальность частных лиц.

- Автоматизация рабочих мест: ИИ может заменить людей на многих финансовых должностях. Это может привести к росту безработицы и социальной напряженности.

Примеры этических дилемм

Давайте рассмотрим несколько конкретных примеров этических дилемм‚ связанных с ИИ в управлении рисками:

- ИИ отказывает в кредите человеку‚ который имеет право на него. Это может произойти из-за предвзятости алгоритма или ошибки в данных.

- ИИ совершает ошибку при алгоритмической торговле‚ что приводит к убыткам для инвесторов. Кто должен возместить эти убытки?

- ИИ выявляет подозрительную транзакцию‚ которая на самом деле является легитимной. Это может привести к необоснованным обвинениям и ущербу репутации.

"Этика – это знание того‚ что ты должен делать‚ а не только знание того‚ что ты можешь делать." ౼ Поттер Стюарт

Как минимизировать этические риски?

К счастью‚ существуют способы минимизировать этические риски‚ связанные с ИИ в управлении рисками. Вот некоторые из них:

- Обеспечение прозрачности алгоритмов: Необходимо разрабатывать алгоритмы‚ которые можно понять и объяснить. Это позволит выявлять и исправлять ошибки и предвзятости.

- Использование разнообразных данных: Для обучения ИИ необходимо использовать данные‚ которые отражают разнообразие населения. Это поможет избежать предвзятости алгоритмов.

- Установление четкой ответственности: Необходимо определить‚ кто несет ответственность за ошибки ИИ. Это поможет обеспечить подотчетность и справедливость.

- Защита конфиденциальности данных: Необходимо собирать и использовать данные в соответствии с законами о конфиденциальности.

- Обучение и переквалификация работников: Необходимо обучать и переквалифицировать работников‚ чтобы они могли работать вместе с ИИ.

Роль регулирования

Регулирование также играет важную роль в минимизации этических рисков‚ связанных с ИИ в финансах. Правительства и регулирующие органы должны разработать правила и стандарты‚ которые обеспечивают прозрачность‚ справедливость и подотчетность использования ИИ.

Примеры регуляторных инициатив

- Законы о защите данных: Эти законы защищают конфиденциальность частных лиц и ограничивают сбор и использование данных.

- Правила о прозрачности алгоритмов: Эти правила требуют‚ чтобы компании раскрывали информацию о том‚ как их алгоритмы принимают решения.

- Стандарты этики ИИ: Эти стандарты устанавливают принципы и руководящие указания для разработки и использования ИИ.

Будущее ИИ в финансах: этический оптимизм

Несмотря на все вызовы‚ мы остаемся этическими оптимистами в отношении будущего ИИ в финансах. Мы верим‚ что при правильном подходе ИИ может принести огромную пользу обществу‚ сделав финансовые услуги более доступными‚ эффективными и справедливыми.

Но для этого необходимо‚ чтобы все заинтересованные стороны – разработчики‚ компании‚ регуляторы и общество в целом – работали вместе над созданием этичной и ответственной экосистемы ИИ.

Надеемся‚ эта статья была полезной и заставила вас задуматься о важности этических вопросов‚ связанных с ИИ в финансах. Будем рады услышать ваши мнения и комментарии!

Подробнее

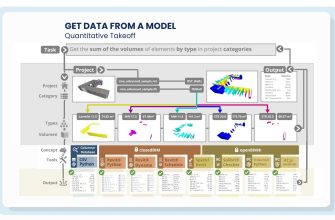

| ИИ в финансовом секторе | Этика алгоритмической торговли | Риски использования ИИ в банках | Регулирование ИИ в финансах | Прозрачность ИИ в финансовых решениях |

|---|---|---|---|---|

| Ответственность за ошибки ИИ в финансах | Влияние ИИ на финансовую стабильность | Этические аспекты кредитного скоринга ИИ | Кибербезопасность ИИ в финансах | ИИ и защита прав потребителей в финансах |

Пояснения к разметке:

- Заголовки: Использованы теги `

`‚ `

`‚ `

`‚ `

` с подчеркиванием и разными цветами для визуального разделения разделов.

- Текст: Основной текст размещен в тегах `

`.

- Списки: Использованы теги `

- ` (ненумерованный список) и `

- Выделение: Использован тег `` для выделения важных моментов.

- Цитата: Цитата оформлена в блоке ` ` с тегом `

`.

- Таблица: Для LSI запросов использована таблица `

` с ссылками ``.

- Детали: Использован тег `

` для скрытия/отображения блока LSI запросов.

- ` (нумерованный список) для структурирования информации.