- Искусственный Интеллект: Кто несет ответственность за решения машин?

- Эволюция Искусственного Интеллекта: Краткий Обзор

- Определение "Ответственности" в Контексте ИИ

- Этические Вызовы, Связанные с ИИ

- Правовые Аспекты Ответственности ИИ

- Примеры Ситуаций, Требующих Определения Ответственности

- Пути Решения Проблемы Ответственности ИИ

- Этические Принципы Разработки и Использования ИИ

- Разработка Правовых Рамок для ИИ

- Технические Решения для Обеспечения Ответственности ИИ

Искусственный Интеллект: Кто несет ответственность за решения машин?

В последнее время мы все чаще сталкиваемся с искусственным интеллектом (ИИ) в различных сферах нашей жизни. Он помогает нам в работе, развлекает нас и даже принимает решения, которые влияют на нашу судьбу. Но по мере того, как ИИ становится все более мощным и автономным, возникает важный вопрос: кто несет ответственность за его действия? Этот вопрос становится особенно актуальным, когда ИИ совершает ошибки или причиняет вред.

Мы, как общество, должны разработать четкие этические принципы и юридические рамки, которые определят, как мы будем взаимодействовать с ИИ и кто будет нести ответственность за его решения. Это сложная задача, требующая участия экспертов из разных областей, включая философию, право, этику и, конечно же, информатику. Но это необходимый шаг для того, чтобы обеспечить безопасное и справедливое использование ИИ в будущем.

Эволюция Искусственного Интеллекта: Краткий Обзор

Прежде чем углубиться в вопросы этики и ответственности, давайте кратко рассмотрим эволюцию искусственного интеллекта. Идея создания машин, способных мыслить и действовать как люди, возникла давно. Однако, только в середине 20-го века, с появлением первых компьютеров, эта идея начала приобретать реальные очертания. Первые программы ИИ были простыми и решали узкоспециализированные задачи. Но с течением времени, благодаря развитию алгоритмов машинного обучения и увеличению вычислительной мощности, ИИ стал способен решать все более сложные задачи.

Сегодня ИИ используеться в самых разных областях: от медицины и финансов до транспорта и развлечений. Он может диагностировать заболевания, управлять беспилотными автомобилями, создавать произведения искусства и даже писать статьи. Но вместе с этими впечатляющими достижениями возникают и новые вызовы, связанные с этикой и ответственностью.

Определение "Ответственности" в Контексте ИИ

Что же означает "ответственность" в контексте искусственного интеллекта? В традиционном понимании, ответственность означает обязанность нести последствия своих действий. Если человек совершает ошибку или причиняет вред, он должен ответить за это перед законом или обществом. Но как применить это понятие к ИИ, который является не человеком, а машиной?

Существует несколько точек зрения на этот вопрос. Некоторые считают, что ответственность за действия ИИ должны нести его создатели – разработчики и инженеры, которые создали алгоритмы и обучили его. Другие полагают, что ответственность должны нести владельцы ИИ – компании или организации, которые используют его в своей деятельности. Третьи предлагают ввести понятие "коллективной ответственности", когда ответственность разделяется между всеми участниками процесса – от разработчиков до пользователей.

Этические Вызовы, Связанные с ИИ

Этика ИИ – это сложная и многогранная область, которая включает в себя множество различных вопросов и проблем. Одна из главных проблем – это предвзятость алгоритмов. ИИ обучается на данных, и если эти данные содержат предвзятости, то ИИ может воспроизводить и усиливать эти предвзятости в своих решениях. Например, если ИИ, используемый для отбора кандидатов на работу, обучен на данных, в которых преобладают мужчины, то он может отдавать предпочтение мужчинам перед женщинами, даже если они имеют одинаковую квалификацию.

Еще одна важная проблема – это прозрачность алгоритмов. Многие современные алгоритмы ИИ, особенно глубокие нейронные сети, являются "черными ящиками". Мы можем видеть, какой результат они выдают, но мы не знаем, как они пришли к этому результату. Это затрудняет выявление и исправление ошибок и предвзятостей в алгоритмах.

Наконец, существует проблема автономии ИИ. По мере того, как ИИ становится все более автономным, возникает вопрос, насколько мы должны позволять ему принимать решения самостоятельно. В каких случаях мы должны вмешиваться и контролировать его действия? Где проходит граница между полезной автономией и опасной безответственностью?

"Искусственный интеллект — это не просто инструмент, это партнер. Мы должны научиться жить и работать вместе, уважая его потенциал и осознавая его ограничения."

— Стивен Хокинг

Правовые Аспекты Ответственности ИИ

В настоящее время правовое регулирование ИИ находится в зачаточном состоянии. Существующие законы и нормы не всегда применимы к новым вызовам, связанным с ИИ. Многие страны и организации разрабатывают новые законы и правила, которые должны определить, как мы будем регулировать ИИ.

Один из главных вопросов – это определение юридического статуса ИИ. Должен ли ИИ рассматриваться как "электронное лицо" с определенными правами и обязанностями? Или он должен оставаться просто инструментом, за который несут ответственность его создатели и владельцы?

Еще один важный вопрос – это ответственность за ущерб, причиненный ИИ. Если беспилотный автомобиль совершает ДТП, кто несет ответственность за причиненный ущерб? Разработчик автомобиля, владелец автомобиля или сам ИИ?

Примеры Ситуаций, Требующих Определения Ответственности

Чтобы лучше понять сложность проблемы ответственности ИИ, давайте рассмотрим несколько конкретных примеров:

- Автономное оружие: Если автономное оружие, которое принимает решения о применении силы самостоятельно, убивает невинных людей, кто несет ответственность?

- Медицинская диагностика: Если ИИ, используемый для медицинской диагностики, ставит неправильный диагноз, что приводит к неправильному лечению и ухудшению здоровья пациента, кто несет ответственность?

- Финансовые решения: Если ИИ, используемый для принятия финансовых решений, совершает ошибку, которая приводит к большим убыткам для инвесторов, кто несет ответственность?

В каждом из этих примеров необходимо определить, кто несет ответственность за действия ИИ и как можно предотвратить подобные ситуации в будущем.

Пути Решения Проблемы Ответственности ИИ

Решение проблемы ответственности ИИ – это сложная задача, требующая комплексного подхода. Необходимо разработать этические принципы, правовые рамки и технические решения, которые позволят нам безопасно и справедливо использовать ИИ в будущем.

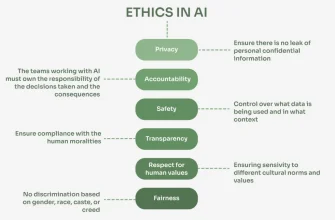

Этические Принципы Разработки и Использования ИИ

Необходимо разработать четкие этические принципы, которые должны лежать в основе разработки и использования ИИ. Эти принципы должны включать в себя такие понятия, как прозрачность, справедливость, подотчетность и уважение к человеческим ценностям.

- Прозрачность: Алгоритмы ИИ должны быть понятными и объяснимыми.

- Справедливость: ИИ не должен дискриминировать людей по каким-либо признакам.

- Подотчетность: Должны быть четко определены лица или организации, несущие ответственность за действия ИИ.

- Уважение к человеческим ценностям: ИИ должен использоваться для улучшения жизни людей и защиты их прав.

Разработка Правовых Рамок для ИИ

Необходимо разработать новые законы и правила, которые будут регулировать использование ИИ. Эти законы должны определять юридический статус ИИ, ответственность за ущерб, причиненный ИИ, и права и обязанности пользователей ИИ.

Технические Решения для Обеспечения Ответственности ИИ

Необходимо разрабатывать технические решения, которые позволят нам контролировать и отслеживать действия ИИ; Эти решения должны включать в себя такие инструменты, как логирование, аудит и мониторинг.

Нам необходимо создавать "объяснимый ИИ" (XAI), который может объяснять свои решения. Это позволит нам понимать, как ИИ приходит к своим выводам, и выявлять и исправлять ошибки и предвзятости в алгоритмах.

Искусственный интеллект – это мощная технология, которая может принести огромную пользу человечеству. Но вместе с этим она несет и серьезные риски. Чтобы обеспечить безопасное и справедливое использование ИИ в будущем, мы должны разработать четкие этические принципы, правовые рамки и технические решения, которые определят, как мы будем взаимодействовать с ИИ и кто будет нести ответственность за его решения.

Мы верим, что совместными усилиями мы сможем создать будущее, в котором ИИ будет служить на благо человечества, а не угрожать ему.

Подробнее

| Этика искусственного интеллекта | Ответственность за ИИ | Правовое регулирование ИИ | Безопасность ИИ | Объяснимый ИИ (XAI) |

|---|---|---|---|---|

| Предвзятость в алгоритмах ИИ | Автономность ИИ | Этические дилеммы ИИ | ИИ и справедливость | Влияние ИИ на общество |