- Этические дилеммы ИИ: Как мы балансируем между здоровьем и приватностью?

- Мониторинг здоровья с помощью ИИ: Возможности и перспективы

- Этические вызовы и риски

- Риски утечки и неправомерного использования данных

- Предвзятость алгоритмов и дискриминация

- Как найти баланс между инновациями и защитой приватности?

- Будущее мониторинга здоровья с ИИ: Наш взгляд

Этические дилеммы ИИ: Как мы балансируем между здоровьем и приватностью?

Все чаще мы сталкиваемся с искусственным интеллектом (ИИ) в самых разных сферах нашей жизни․ И, наверное, одна из самых чувствительных областей – это здравоохранение․ Представьте себе: ИИ мониторит наше состояние здоровья, предсказывает возможные заболевания и даже предлагает персонализированные планы лечения․ Звучит как научная фантастика, правда? Но это уже реальность․ Однако, вместе с огромными возможностями, приходят и огромные этические вопросы․ Как далеко мы готовы зайти, доверяя ИИ нашу личную информацию? Где та грань, за которой забота о здоровье превращается в нарушение приватности?

В этой статье мы погрузимся в мир этических дилемм, связанных с использованием ИИ в мониторинге здоровья․ Мы рассмотрим, какие вызовы стоят перед нами, какие риски существуют и как можно найти баланс между инновациями и защитой наших прав․ Нам предстоит обсудить, как сделать так, чтобы ИИ служил нам во благо, не превращаясь в инструмент тотального контроля и дискриминации․

Мониторинг здоровья с помощью ИИ: Возможности и перспективы

Мы живем в эпоху, когда технологии развиваются с невероятной скоростью․ ИИ уже сегодня способен анализировать огромные объемы данных о нашем здоровье – от показателей с фитнес-трекеров до результатов сложных медицинских анализов․ Он может выявлять закономерности, которые не заметит даже опытный врач, предсказывать развитие заболеваний на ранних стадиях и предлагать индивидуальные решения для каждого пациента․ Это открывает перед нами совершенно новые горизонты в профилактике и лечении болезней․

Например, представьте себе систему, которая отслеживает ваш сердечный ритм, уровень сахара в крови и другие важные показатели․ Если ИИ заметит какие-либо отклонения от нормы, он немедленно предупредит вас и вашего врача․ Это позволит вовремя принять меры и предотвратить серьезные осложнения․ Или, скажем, ИИ анализирует ваши генетические данные и предсказывает вашу предрасположенность к определенным заболеваниям․ На основе этой информации вы сможете изменить свой образ жизни, чтобы снизить риск развития этих болезней․

Но все эти возможности связаны с одним очень важным вопросом: кто имеет доступ к этим данным и как они используются? И вот тут мы и подходим к самым сложным этическим дилеммам․

Этические вызовы и риски

Когда речь идет о мониторинге здоровья с помощью ИИ, возникает целый ряд этических вопросов, которые требуют серьезного обсуждения и поиска решений․ Давайте рассмотрим некоторые из них:

- Приватность и конфиденциальность․ Кто имеет доступ к нашим данным о здоровье? Как они хранятся и защищаются от несанкционированного доступа? Как долго они хранятся и как удаляются?

- Согласие и прозрачность․ Осознаем ли мы, на что даем согласие, когда разрешаем ИИ собирать и анализировать наши данные о здоровье? Понимаем ли мы, как работают эти системы и какие решения они принимают на основе наших данных?

- Дискриминация и предвзятость․ Могут ли алгоритмы ИИ быть предвзятыми и дискриминировать определенные группы людей? Например, могут ли они принимать решения, основанные на расе, поле или социальном статусе?

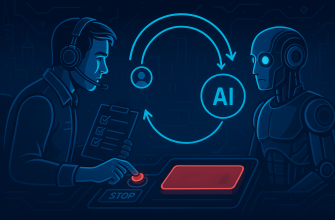

- Ответственность и подотчетность․ Кто несет ответственность, если ИИ совершает ошибку и причиняет вред пациенту? Как мы можем привлечь к ответственности разработчиков и операторов этих систем?

- Автономия и контроль․ Не теряем ли мы контроль над своей жизнью, когда доверяем ИИ принимать решения о нашем здоровье? Не становимся ли мы зависимыми от этих систем?

Эти вопросы не имеют простых ответов․ Они требуют глубокого анализа, широкой общественной дискуссии и разработки четких этических принципов и нормативных актов․

Риски утечки и неправомерного использования данных

Один из самых серьезных рисков, связанных с использованием ИИ в мониторинге здоровья, – это утечка и неправомерное использование данных․ Представьте себе, что ваши данные о здоровье попадают в руки страховой компании, которая использует их для повышения страховых взносов или отказа в страховании․ Или, например, работодатель получает доступ к вашим данным и использует их для принятия решений о приеме на работу или продвижении по службе․ Такие сценарии могут иметь серьезные последствия для вашей жизни и благополучия․

Чтобы предотвратить такие ситуации, необходимо обеспечить надежную защиту данных о здоровье․ Это означает использование современных технологий шифрования, строгий контроль доступа к данным и регулярный аудит систем безопасности․ Кроме того, необходимо разработать четкие правила, определяющие, кто имеет право доступа к этим данным и как они могут быть использованы․

Предвзятость алгоритмов и дискриминация

Еще один важный риск – это предвзятость алгоритмов ИИ․ Алгоритмы ИИ обучаются на основе данных, и если эти данные содержат предвзятости, то алгоритмы могут унаследовать эти предвзятости и принимать дискриминационные решения․ Например, если алгоритм обучается на данных, в которых недостаточно представлены определенные расовые или этнические группы, то он может хуже диагностировать заболевания у представителей этих групп․

Чтобы избежать предвзятости алгоритмов, необходимо использовать разнообразные и репрезентативные наборы данных для обучения․ Кроме того, необходимо тщательно проверять алгоритмы на наличие предвзятостей и корректировать их, если они обнаружены․ Также важно, чтобы разработчики алгоритмов понимали, как их решения могут повлиять на различные группы людей, и принимали меры для предотвращения дискриминации․

"Технологии сами по себе не являются ни хорошими, ни плохими; и не являются нейтральными․"

⏤ Мелвин Кранцберг

Как найти баланс между инновациями и защитой приватности?

Итак, мы видим, что использование ИИ в мониторинге здоровья открывает перед нами огромные возможности, но и создает серьезные этические вызовы․ Как же нам найти баланс между инновациями и защитой приватности? Как сделать так, чтобы ИИ служил нам во благо, не превращаясь в инструмент тотального контроля и дискриминации?

На наш взгляд, для этого необходимо предпринять ряд шагов:

- Разработать четкие этические принципы и нормативные акты; Необходимо установить четкие правила, определяющие, как можно использовать ИИ в мониторинге здоровья, кто имеет доступ к данным о здоровье и как они должны быть защищены․

- Обеспечить прозрачность и подотчетность; Необходимо, чтобы люди понимали, как работают системы ИИ, какие решения они принимают на основе их данных и кто несет ответственность за эти решения․

- Получать информированное согласие․ Необходимо, чтобы люди осознавали, на что дают согласие, когда разрешают ИИ собирать и анализировать их данные о здоровье․

- Защищать данные о здоровье․ Необходимо использовать современные технологии шифрования, строгий контроль доступа к данным и регулярный аудит систем безопасности․

- Бороться с предвзятостью алгоритмов․ Необходимо использовать разнообразные и репрезентативные наборы данных для обучения алгоритмов, тщательно проверять алгоритмы на наличие предвзятостей и корректировать их, если они обнаружены․

- Поощрять общественную дискуссию․ Необходимо проводить широкую общественную дискуссию о том, как мы хотим использовать ИИ в мониторинге здоровья и какие этические границы мы готовы установить․

Только совместными усилиями мы сможем найти правильный баланс между инновациями и защитой приватности и сделать так, чтобы ИИ служил нам во благо․

Будущее мониторинга здоровья с ИИ: Наш взгляд

Мы верим, что будущее мониторинга здоровья с ИИ может быть очень светлым․ Если мы сможем решить этические вопросы, то ИИ станет мощным инструментом для улучшения здоровья и качества жизни людей․ Он поможет нам предотвращать заболевания, лечить их на ранних стадиях и персонализировать медицинскую помощь․ Он позволит нам жить дольше и здоровее․

Но для этого нам необходимо быть бдительными и помнить о том, что технологии – это всего лишь инструменты․ Они могут быть использованы как во благо, так и во зло․ И только от нас зависит, как мы будем их использовать․ Мы должны стремиться к тому, чтобы ИИ служил нам, а не наоборот․ Мы должны помнить о том, что здоровье и приватность – это наши самые ценные активы, и мы должны защищать их любой ценой․

Мы надеемся, что эта статья помогла вам лучше понять этические дилеммы, связанные с использованием ИИ в мониторинге здоровья․ Мы призываем вас к активному участию в общественной дискуссии и к принятию ответственных решений в этой важной области․

Подробнее

| ИИ в здравоохранении | Этика ИИ | Приватность данных | Мониторинг здоровья ИИ | Алгоритмы здоровья |

| Безопасность данных в медицине | Дискриминация ИИ в медицине | Регулирование ИИ в здравоохранении | Информированное согласие ИИ | Этические принципы ИИ в медицине |