- Этические дилеммы ИИ: Как не дать климатическим моделям обмануть будущее?

- Почему этика важна в климатических моделях на основе ИИ?

- Прозрачность и объяснимость: Открываем "черный ящик"

- Учет предвзятости данных: Избавляемся от "эха прошлого"

- Ответственность и подотчетность: Кто виноват, если модель ошиблась?

- Принципы этичного использования ИИ в климатических моделях

- Как обеспечить соблюдение этических принципов?

- Примеры этических дилемм в климатических моделях

- Решения и компромиссы

- Будущее этичного ИИ в климатических моделях

Этические дилеммы ИИ: Как не дать климатическим моделям обмануть будущее?

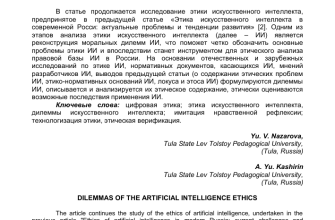

Когда мы говорим об искусственном интеллекте (ИИ), рисующем картину будущего нашей планеты, сразу возникает ощущение чего-то одновременно захватывающего и немного пугающего. Климатические модели, основанные на ИИ, обещают предоставить нам беспрецедентную точность в прогнозировании изменений климата. Но вместе с этой мощью приходит и огромная ответственность. Как убедиться, что эти модели не только точны, но и этичны? Как избежать предвзятости, манипуляций и нежелательных последствий?

Вместе с вами мы отправимся в путешествие по миру этических рамок для ИИ в области климатических моделей. Мы рассмотрим, какие проблемы могут возникнуть, какие принципы следует учитывать и как обеспечить, чтобы эти мощные инструменты служили на благо человечества.

Почему этика важна в климатических моделях на основе ИИ?

Представьте себе ситуацию: климатическая модель, разработанная на основе ИИ, предсказывает катастрофические последствия для определенного региона. На основании этого прогноза принимаются решения об эвакуации, инвестициях в инфраструктуру и даже изменении политики. Но что, если модель ошибочна? Что, если она предвзята из-за неполных или искаженных данных? Последствия могут быть разрушительными.

Именно поэтому этика играет ключевую роль. Климатические модели на основе ИИ – это не просто сложные алгоритмы. Это инструменты, которые влияют на жизни людей, на экономику и на будущее нашей планеты. И мы должны убедиться, что эти инструменты используются ответственно и справедливо.

Прозрачность и объяснимость: Открываем "черный ящик"

Одной из главных проблем с ИИ является его "чернота". Многие модели, особенно глубокие нейронные сети, работают как непрозрачные ящики. Мы видим входные данные и выходные результаты, но не понимаем, как именно модель пришла к такому выводу. В контексте климатических моделей это может быть очень опасно. Если мы не понимаем, почему модель предсказывает определенный сценарий, нам сложно оценить ее надежность и выявить возможные ошибки или предвзятости.

Чтобы решить эту проблему, необходимо стремиться к большей прозрачности и объяснимости. Это означает, что мы должны разрабатывать модели, которые могут объяснить свои решения. Мы должны понимать, какие факторы оказывают наибольшее влияние на прогнозы и как модель учитывает различные неопределенности;

Учет предвзятости данных: Избавляемся от "эха прошлого"

ИИ учится на данных. Если данные содержат предвзятости, модель неизбежно воспроизведет и усилит их. В контексте климатических моделей это может привести к искаженным прогнозам, которые непропорционально сильно затрагивают определенные группы населения или регионы.

Например, если исторические данные о климатических изменениях в основном сосредоточены на развитых странах, модель может недооценивать риски для развивающихся стран. Или, если данные собирались с использованием определенных методов, которые систематически исключают определенные группы населения, модель может принимать решения, которые усугубляют неравенство.

Чтобы избежать этой проблемы, необходимо тщательно анализировать данные, используемые для обучения моделей. Мы должны выявлять и исправлять предвзятости, а также использовать разнообразные и репрезентативные наборы данных.

Ответственность и подотчетность: Кто виноват, если модель ошиблась?

Когда климатическая модель на основе ИИ совершает ошибку, кто несет ответственность? Разработчики модели? Пользователи, которые принимают решения на основе ее прогнозов? Или, возможно, никто не виноват?

Этот вопрос не имеет простого ответа. Но важно, чтобы были четкие механизмы ответственности и подотчетности. Разработчики моделей должны нести ответственность за обеспечение их точности и надежности. Пользователи должны критически оценивать прогнозы и учитывать их неопределенности. И, конечно, должны быть механизмы для исправления ошибок и компенсации ущерба, если он был причинен.

"Искусственный интеллект ౼ это не просто технология, это отражение наших ценностей и приоритетов. Мы должны убедиться, что он используется для создания справедливого и устойчивого будущего для всех." ౼ Кати Мацумото, эксперт по этике ИИ

Принципы этичного использования ИИ в климатических моделях

Какие принципы должны лежать в основе этичного использования ИИ в климатических моделях? Мы считаем, что ключевыми являются следующие:

- Прозрачность: Модели должны быть понятными и объяснимыми.

- Справедливость: Модели должны учитывать интересы всех групп населения и регионов.

- Ответственность: Должны быть четкие механизмы ответственности и подотчетности.

- Надежность: Модели должны быть точными и надежными.

- Безопасность: Модели не должны представлять угрозу для людей или окружающей среды.

Как обеспечить соблюдение этических принципов?

Соблюдение этических принципов – это не просто вопрос хороших намерений. Это требует конкретных мер и инструментов. Вот некоторые из них:

- Разработка этических кодексов и стандартов: Необходимо разработать четкие этические кодексы и стандарты для разработчиков и пользователей климатических моделей на основе ИИ.

- Создание независимых органов контроля: Необходимо создать независимые органы контроля, которые будут следить за соблюдением этических принципов и рассматривать жалобы на нарушения.

- Обучение и повышение осведомленности: Необходимо обучать разработчиков, пользователей и широкую общественность этическим вопросам, связанным с ИИ.

- Разработка инструментов для оценки и смягчения предвзятости: Необходимо разрабатывать инструменты, которые помогут выявлять и смягчать предвзятости в данных и моделях.

- Содействие сотрудничеству и обмену знаниями: Необходимо содействовать сотрудничеству и обмену знаниями между разработчиками, пользователями, учеными и политиками.

Примеры этических дилемм в климатических моделях

Чтобы лучше понять, какие этические проблемы могут возникнуть на практике, рассмотрим несколько конкретных примеров:

- Распределение ресурсов: Климатическая модель предсказывает, что определенный регион столкнется с серьезной нехваткой воды. На основании этого прогноза принимается решение о перераспределении водных ресурсов. Но что, если это решение приведет к экономическому ущербу для другого региона? Как сбалансировать интересы разных регионов?

- Принятие решений в условиях неопределенности: Климатическая модель предоставляет несколько возможных сценариев будущего, каждый из которых имеет свою вероятность. Какой сценарий следует использовать для принятия решений? Как учитывать неопределенности и риски?

- Использование данных о местоположении: Климатическая модель использует данные о местоположении людей для прогнозирования их уязвимости к климатическим изменениям. Как обеспечить конфиденциальность этих данных и избежать дискриминации?

Решения и компромиссы

Решение этих этических дилемм требует тщательного анализа и взвешенного подхода. Часто приходится идти на компромиссы и учитывать разные точки зрения. Важно, чтобы решения принимались открыто и прозрачно, с участием всех заинтересованных сторон.

Например, в случае распределения водных ресурсов можно использовать методы многокритериального анализа, чтобы учесть экономические, социальные и экологические факторы. При принятии решений в условиях неопределенности можно использовать сценарное планирование и анализ чувствительности. А при использовании данных о местоположении можно применять методы анонимизации и шифрования.

Будущее этичного ИИ в климатических моделях

Мы уверены, что будущее этичного ИИ в климатических моделях выглядит многообещающим. По мере развития технологий и накопления опыта мы будем лучше понимать, как использовать ИИ для решения самых сложных климатических проблем. Но для этого необходимо продолжать работу над этическими принципами и механизмами их реализации. Мы должны помнить, что ИИ – это всего лишь инструмент, и его успех зависит от нас, от нашей мудрости и ответственности;

Вместе мы можем создать будущее, в котором ИИ будет служить на благо человечества и помогать нам строить устойчивый и справедливый мир.

Подробнее

| Климатические модели ИИ | Этика искусственного интеллекта | Предвзятость данных | Прозрачность ИИ | Ответственность ИИ |

|---|---|---|---|---|

| Климатические прогнозы ИИ | Этические дилеммы ИИ | Устойчивое развитие | Справедливость ИИ | Риски ИИ |