- Этические дилеммы ИИ в медицине: Как технологии меняют правила игры

- Что такое этика ИИ в медицине?

- Основные этические проблемы ИИ в медицине

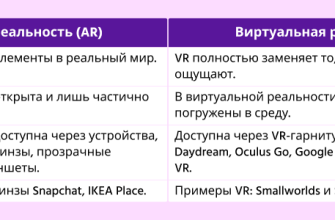

- Конфиденциальность и защита данных

- Ответственность и подотчетность

- Справедливость и равенство доступа

- Прозрачность и объяснимость

- Автономия и достоинство человека

- Пути решения этических проблем

- Примеры этических дилемм на практике

- Будущее этики ИИ в медицине

Этические дилеммы ИИ в медицине: Как технологии меняют правила игры

В последние годы искусственный интеллект (ИИ) стремительно ворвался в нашу жизнь, и медицина не стала исключением. Мы видим, как ИИ помогает в диагностике заболеваний, разработке новых лекарств, персонализированном лечении и даже в проведении сложных хирургических операций. Однако, вместе с огромными возможностями, ИИ принес и новые этические вызовы, требующие внимательного рассмотрения и обсуждения.

Представьте себе мир, где ИИ безошибочно ставит диагнозы, предсказывает развитие болезней и подбирает оптимальное лечение для каждого пациента. Это звучит как утопия, но уже сегодня мы делаем уверенные шаги в этом направлении. Но что, если ИИ ошибется? Кто будет нести ответственность за последствия? Как обеспечить справедливость и равенство доступа к этим передовым технологиям?

Что такое этика ИИ в медицине?

Этика ИИ в медицине – это свод принципов и правил, которые регулируют разработку, внедрение и использование ИИ-систем в сфере здравоохранения. Она охватывает широкий круг вопросов, от защиты персональных данных пациентов до обеспечения прозрачности и подотчетности алгоритмов. Важно понимать, что этика ИИ – это не просто абстрактные философские рассуждения, а вполне конкретные практические задачи, требующие решения.

Нам кажется, что главная цель этики ИИ в медицине – это обеспечить, чтобы технологии служили интересам пациентов и общества в целом, не нанося вреда и не ущемляя чьи-либо права. Это требует постоянного диалога между разработчиками, врачами, пациентами, юристами и философами.

Основные этические проблемы ИИ в медицине

Существует множество этических вопросов, связанных с использованием ИИ в медицине. Давайте рассмотрим некоторые из наиболее важных:

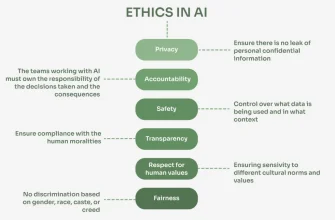

Конфиденциальность и защита данных

ИИ-системы в медицине работают с огромными объемами персональных данных пациентов, включая медицинские карты, результаты анализов, генетическую информацию и многое другое. Обеспечение конфиденциальности и защиты этих данных – одна из главных задач. Важно, чтобы данные не попали в руки злоумышленников, не использовались для дискриминации или других неправомерных целей.

Мы считаем, что необходимо разработать строгие правила и механизмы контроля за доступом к данным, а также внедрить надежные системы защиты от кибератак. Пациенты должны иметь право знать, какие данные о них собираются, как они используются и кому передаются.

Ответственность и подотчетность

Если ИИ-система допускает ошибку, кто будет нести ответственность за последствия? Разработчик, врач, больница? Этот вопрос пока не имеет однозначного ответа. Необходимо разработать четкие механизмы определения ответственности и подотчетности за действия ИИ.

На наш взгляд, важно, чтобы врачи сохраняли контроль над процессом принятия решений и не полагались слепо на ИИ. ИИ должен быть инструментом, помогающим врачу, а не заменяющим его.

Справедливость и равенство доступа

ИИ-технологии могут быть дорогими, и не все пациенты смогут позволить себе воспользоваться ими. Это может привести к усилению неравенства в доступе к медицинской помощи. Необходимо обеспечить, чтобы ИИ-технологии были доступны всем, независимо от их социального статуса и места жительства.

Мы убеждены, что государство и общественные организации должны играть активную роль в обеспечении справедливого доступа к ИИ-технологиям в медицине.

Прозрачность и объяснимость

Многие ИИ-системы, особенно те, которые основаны на глубоком обучении, работают как "черный ящик". Врачам и пациентам сложно понять, как ИИ пришел к тому или иному выводу. Это затрудняет доверие к ИИ и принятие решений на основе его рекомендаций. Необходимо разрабатывать ИИ-системы, которые будут прозрачными и объяснимыми.

Нам кажется, что важно, чтобы врачи могли понимать логику работы ИИ и объяснять пациентам, почему было принято то или иное решение.

Автономия и достоинство человека

ИИ не должен подменять собой человеческое общение и сочувствие, которые так важны в медицине. Врачи должны сохранять эмпатию и уважение к пациентам, даже если они используют ИИ для диагностики и лечения.

Мы считаем, что необходимо помнить, что медицина – это не только наука, но и искусство. Врач должен быть не просто специалистом, но и человеком, способным сочувствовать и поддерживать пациента.

"Технологический прогресс неизбежен. Вопрос в том, как мы его используем."

– Стивен Хокинг

Пути решения этических проблем

Решение этических проблем ИИ в медицине – это сложная и многогранная задача, требующая совместных усилий всех заинтересованных сторон. Вот некоторые из возможных путей решения:

- Разработка этических кодексов и стандартов для ИИ в медицине.

- Создание независимых экспертных советов для оценки этичности ИИ-систем.

- Обучение врачей и разработчиков этическим аспектам ИИ.

- Проведение общественных дискуссий и опросов для выявления общественного мнения по вопросам этики ИИ.

- Разработка законодательства, регулирующего использование ИИ в медицине.

Примеры этических дилемм на практике

Давайте рассмотрим несколько конкретных примеров этических дилемм, с которыми мы можем столкнуться при использовании ИИ в медицине:

- Диагностика рака кожи: ИИ-система обнаружила у пациента подозрительное образование на коже; Однако, биопсия не подтвердила наличие рака. Должен ли врач доверять ИИ и настаивать на удалении образования, или он должен полагаться на результаты биопсии?

- Прогнозирование риска сердечно-сосудистых заболеваний: ИИ-система предсказала высокий риск сердечного приступа у пациента. Однако, пациент чувствует себя хорошо и не хочет принимать лекарства; Должен ли врач настаивать на лечении, или он должен уважать право пациента на автономию?

- Распределение ограниченных ресурсов: В больнице не хватает аппаратов искусственной вентиляции легких. ИИ-система предлагает распределить аппараты между пациентами на основе их прогнозируемой выживаемости. Должен ли врач следовать рекомендациям ИИ, или он должен учитывать другие факторы, такие как возраст, социальный статус и желание пациента жить?

Будущее этики ИИ в медицине

Этика ИИ в медицине – это динамично развивающаяся область. По мере развития технологий и накопления опыта будут возникать новые этические вызовы, требующие решения. Важно, чтобы мы постоянно пересматривали и обновляли наши этические принципы и правила, чтобы они соответствовали современным реалиям.

Мы верим, что ИИ может стать мощным инструментом для улучшения здоровья и благополучия людей. Однако, для этого необходимо, чтобы мы использовали его ответственно и этично. Только в этом случае мы сможем реализовать весь потенциал ИИ в медицине и избежать негативных последствий.

Подробнее

| ИИ в здравоохранении | Этика алгоритмов в медицине | Конфиденциальность медицинских данных | Ответственность за ошибки ИИ | Справедливый доступ к ИИ в медицине |

|---|---|---|---|---|

| Прозрачность ИИ в диагностике | Автономия пациента и ИИ | Этические кодексы для ИИ в медицине | ИИ и врачебная ошибка | Влияние ИИ на медицинскую практику |

На этом статья заканчивается.