- Этические дилеммы: Как Искусственный Интеллект меняет доклинические исследования лекарств

- Роль ИИ в доклинических исследованиях

- Этические вызовы использования ИИ

- Предвзятость данных и ее последствия

- Прозрачность и объяснимость ИИ

- Ответственность за ошибки ИИ

- Этические принципы использования ИИ в доклинических исследованиях

- Рекомендации для разработчиков ИИ

- Рекомендации для ученых и исследователей

- Будущее этики ИИ в разработке лекарств

Этические дилеммы: Как Искусственный Интеллект меняет доклинические исследования лекарств

Мир разработки лекарств стремительно меняется. Искусственный интеллект (ИИ) уже не просто модное слово, а мощный инструмент, который перекраивает доклинические исследования. Мы, как свидетели этой революции, видим огромный потенциал для ускорения процесса создания новых лекарств, снижения затрат и повышения эффективности. Но вместе с тем, возникают и серьезные этические вопросы, которые требуют внимательного рассмотрения.

В этой статье мы погрузимся в мир этических аспектов применения ИИ на доклиническом этапе разработки лекарств. Мы рассмотрим, как ИИ влияет на процесс отбора кандидатов в лекарства, моделирование заболеваний, проведение экспериментов на животных и анализ данных. И, конечно же, обсудим, какие меры необходимо принять, чтобы гарантировать, что ИИ используется ответственно и этично.

Роль ИИ в доклинических исследованиях

Доклинические исследования – это фундамент, на котором строится вся разработка лекарств. Именно здесь, на этапе лабораторных и животных испытаний, определяется, будет ли потенциальное лекарство эффективным и безопасным для человека. ИИ способен радикально изменить этот процесс, предлагая новые возможности для анализа данных, прогнозирования результатов и оптимизации экспериментов.

Например, алгоритмы машинного обучения могут анализировать огромные объемы данных о химических соединениях, чтобы предсказать их активность против определенных мишеней. Это позволяет существенно сократить время и затраты на поиск перспективных кандидатов в лекарства. ИИ также может использоваться для создания более точных моделей заболеваний, что позволяет проводить более эффективные испытания на животных и лучше прогнозировать результаты клинических исследований.

- Идентификация мишеней лекарств: ИИ анализирует геномные и протеомные данные для выявления новых мишеней для лекарственного воздействия.

- Виртуальный скрининг: ИИ отбирает потенциальные кандидаты в лекарства из миллионов соединений, используя алгоритмы машинного обучения.

- Прогнозирование токсичности: ИИ предсказывает токсичность соединений на основе их химической структуры, снижая необходимость в дорогостоящих и длительных экспериментах на животных.

- Моделирование заболеваний: ИИ создает более точные модели заболеваний, что позволяет проводить более эффективные доклинические исследования.

Этические вызовы использования ИИ

Внедрение ИИ в доклинические исследования, при всей его перспективности, несет в себе ряд этических вызовов, которые требуют серьезного внимания. Мы должны понимать, что ИИ – это инструмент, и его использование должно быть направлено на благо человечества, а не наоборот.

Предвзятость данных: Алгоритмы ИИ обучаются на данных, и если эти данные предвзяты, то и результаты работы ИИ будут предвзятыми. Это может привести к тому, что лекарства будут разрабатываться только для определенных групп населения, игнорируя потребности других. Например, если данные для обучения модели содержат информацию только о мужчинах, то модель может быть неэффективной для женщин.

Прозрачность и объяснимость: Многие алгоритмы ИИ работают как "черный ящик", и сложно понять, почему они принимают те или иные решения. Это затрудняет проверку результатов и может привести к недоверию к ИИ. Важно, чтобы алгоритмы ИИ были прозрачными и объяснимыми, чтобы ученые могли понимать, как они работают и почему они принимают те или иные решения.

Ответственность: Кто несет ответственность за ошибки, допущенные ИИ? Если ИИ предсказывает, что лекарство безопасно, а на самом деле оно оказывается токсичным, кто будет нести ответственность – разработчики ИИ, ученые, которые использовали ИИ, или компания-производитель лекарства? Этот вопрос требует четкого ответа.

Предвзятость данных и ее последствия

Предвзятость данных – это одна из самых серьезных проблем, связанных с использованием ИИ в доклинических исследованиях. Если данные, на которых обучается ИИ, не отражают разнообразие популяции, то результаты работы ИИ могут быть неточными и даже опасными. Например, если данные о генетических особенностях заболевания содержат информацию только о европейцах, то ИИ может быть неэффективным для пациентов африканского происхождения.

Чтобы избежать предвзятости данных, необходимо использовать разнообразные и репрезентативные наборы данных. Важно также учитывать социальные, экономические и культурные факторы, которые могут влиять на результаты исследований. Кроме того, необходимо регулярно проверять работу ИИ на разных группах населения, чтобы выявлять и устранять предвзятости.

Прозрачность и объяснимость ИИ

Прозрачность и объяснимость ИИ – это еще один важный этический аспект. Ученые должны понимать, как работает ИИ и почему он принимает те или иные решения. Это необходимо для того, чтобы можно было проверить результаты работы ИИ, выявить ошибки и улучшить алгоритмы. Кроме того, прозрачность и объяснимость ИИ повышают доверие к этой технологии.

Для повышения прозрачности и объяснимости ИИ можно использовать различные методы, такие как визуализация данных, анализ чувствительности и объяснимое машинное обучение. Эти методы позволяют понять, какие факторы влияют на решения ИИ и как можно улучшить его работу.

"Этика – это знание того, что правильно, а что нет, и когда вы сомневаетесь, выбирайте правильное."

⎻ Уоррен Баффет

Ответственность за ошибки ИИ

Вопрос об ответственности за ошибки ИИ – один из самых сложных и спорных. Если ИИ допускает ошибку, которая приводит к негативным последствиям, кто должен нести ответственность? Разработчики ИИ, ученые, которые использовали ИИ, или компания-производитель лекарства? Этот вопрос требует четкого юридического и этического регулирования.

Этические принципы использования ИИ в доклинических исследованиях

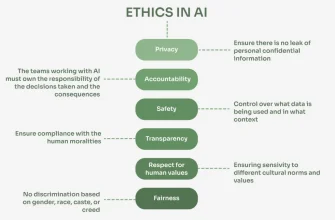

Чтобы гарантировать, что ИИ используется ответственно и этично в доклинических исследованиях, необходимо придерживаться ряда этических принципов. Эти принципы должны быть направлены на защиту прав и интересов всех заинтересованных сторон, включая пациентов, ученых, животных и общество в целом.

- Принцип благодеяния: ИИ должен использоваться для достижения блага и предотвращения вреда.

- Принцип справедливости: ИИ должен использоваться справедливо и не должен дискриминировать определенные группы населения.

- Принцип уважения автономии: Пациенты должны иметь право знать о том, что ИИ используется в их лечении, и должны иметь право отказаться от использования ИИ.

- Принцип прозрачности: Алгоритмы ИИ должны быть прозрачными и объяснимыми.

- Принцип ответственности: Необходимо определить, кто несет ответственность за ошибки, допущенные ИИ.

Рекомендации для разработчиков ИИ

Разработчики ИИ играют ключевую роль в обеспечении этичного использования ИИ в доклинических исследованиях. Они должны разрабатывать алгоритмы, которые являются прозрачными, объяснимыми и непредвзятыми. Кроме того, они должны предоставлять пользователям информацию о том, как работает ИИ и какие ограничения он имеет;

- Разрабатывайте прозрачные и объяснимые алгоритмы.

- Используйте разнообразные и репрезентативные наборы данных.

- Регулярно проверяйте работу ИИ на разных группах населения.

- Предоставляйте пользователям информацию о том, как работает ИИ и какие ограничения он имеет.

- Сотрудничайте с этиками и юристами для решения этических вопросов.

Рекомендации для ученых и исследователей

Ученые и исследователи, использующие ИИ в доклинических исследованиях, должны критически оценивать результаты работы ИИ и не должны слепо доверять его рекомендациям. Они должны также учитывать этические принципы и рекомендации для разработчиков ИИ.

- Критически оценивайте результаты работы ИИ.

- Учитывайте этические принципы.

- Сотрудничайте с разработчиками ИИ для улучшения алгоритмов.

- Сообщайте о любых проблемах, связанных с использованием ИИ.

Будущее этики ИИ в разработке лекарств

Этические вопросы, связанные с использованием ИИ в разработке лекарств, будут становиться все более актуальными по мере развития этой технологии. Необходимо разрабатывать четкие этические нормы и правила, которые будут регулировать использование ИИ в этой области. Кроме того, необходимо проводить обучение и повышение квалификации специалистов в области этики ИИ.

Мы уверены, что при правильном подходе ИИ может стать мощным инструментом для улучшения здоровья человечества. Но для этого необходимо учитывать этические аспекты и использовать ИИ ответственно и этично.

Подробнее

| LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос |

|---|---|---|---|---|

| ИИ в фармацевтике | Этика машинного обучения | Безопасность ИИ в медицине | Доклинические испытания и ИИ | Предвзятость алгоритмов |

| ИИ и животные в науке | Прозрачность ИИ | Ответственность ИИ | Применение ИИ в биофарме | Регулирование ИИ в медицине |