- Этические дилеммы: Как мы решаем, что правильно для автономных машин?

- Автономные системы: что это такое и где они встречаются?

- Основные этические вызовы

- Ответственность

- Предвзятость и дискриминация

- Прозрачность и объяснимость

- Конфиденциальность

- Принципы этичного развития ИИ

- Как мы можем повлиять на будущее ИИ?

Этические дилеммы: Как мы решаем, что правильно для автономных машин?

В наш век стремительного развития технологий, когда искусственный интеллект (ИИ) становится все более интегрированным в нашу повседневную жизнь, мы сталкиваемся с рядом этических вопросов, требующих внимательного осмысления. Автономные системы принятия решений, от беспилотных автомобилей до алгоритмов, определяющих выдачу кредитов, несут в себе огромный потенциал, но и сопряжены с серьезными рисками. Как мы можем гарантировать, что эти системы действуют в соответствии с нашими ценностями и не наносят вреда?

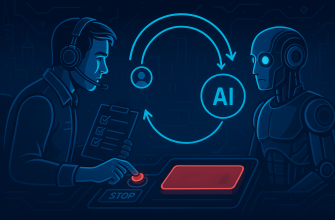

Мы, как общество, должны активно участвовать в формировании этических рамок для ИИ. Это не просто задача для ученых и инженеров; это вопрос, который касается каждого из нас. Ведь именно мы будем жить в мире, где решения, влияющие на нашу жизнь, принимаются машинами. И от того, насколько хорошо мы продумаем этические принципы, будет зависеть качество нашей жизни.

Автономные системы: что это такое и где они встречаются?

Прежде чем углубляться в этические дебри, давайте определимся с терминологией. Под автономными системами принятия решений мы подразумеваем системы, способные принимать решения без прямого вмешательства человека. Они используют алгоритмы, данные и машинное обучение для анализа ситуации и выбора оптимального, по их мнению, действия.

Примеры автономных систем окружают нас повсюду:

- Беспилотные автомобили: Они анализируют дорожную обстановку и принимают решения о скорости, направлении движения и торможении.

- Алгоритмы кредитного скоринга: Они оценивают кредитоспособность заемщиков на основе множества факторов и решают, выдавать ли кредит.

- Системы автоматической торговли на бирже: Они анализируют рыночные данные и совершают сделки без участия трейдера.

- Системы диагностики в медицине: Они анализируют медицинские изображения и данные пациентов, помогая врачам ставить диагнозы.

- Системы управления энергосетями: Они оптимизируют распределение электроэнергии, учитывая спрос и предложение.

Этот список можно продолжать долго, и с каждым годом автономные системы становятся все более распространенными и сложными. Это означает, что этические вопросы, связанные с их использованием, становятся все более актуальными.

Основные этические вызовы

Внедрение автономных систем ставит перед нами ряд сложных этических вопросов. Вот некоторые из наиболее важных:

Ответственность

Кто несет ответственность, если автономная система совершит ошибку, которая приведет к ущербу или травмам? Производитель, разработчик, владелец или сама система? Этот вопрос требует четкого юридического и этического регулирования.

Например, если беспилотный автомобиль станет причиной аварии, кто будет виноват? Программист, который допустил ошибку в коде? Производитель, который не провел достаточные испытания? Владелец автомобиля, который не следил за его техническим состоянием? Или сам автомобиль, как автономная сущность?

Предвзятость и дискриминация

Алгоритмы обучаются на данных, и если эти данные содержат предвзятости, то алгоритмы будут воспроизводить и даже усиливать их. Это может привести к дискриминации по признаку расы, пола, возраста или другим критериям.

Например, если алгоритм кредитного скоринга обучался на данных, где исторически кредиты чаще выдавались мужчинам, то он может несправедливо отказывать женщинам в кредитах. Или, если система распознавания лиц лучше распознает лица людей с европейской внешностью, чем лица людей с африканской внешностью, это может привести к ошибкам и несправедливости в системах безопасности.

Прозрачность и объяснимость

Как мы можем понять, почему автономная система приняла то или иное решение? Алгоритмы часто бывают сложными и непрозрачными, что затрудняет понимание их логики. Это особенно важно в ситуациях, когда решения системы имеют серьезные последствия.

Если система медицинской диагностики поставила диагноз, который отличается от мнения врача, как мы можем понять, почему система пришла к такому выводу? Если алгоритм отбора кандидатов на работу отклонил резюме, как мы можем узнать, почему? Без прозрачности и объяснимости, мы не можем доверять автономным системам.

Конфиденциальность

Автономные системы собирают и обрабатывают огромные объемы данных о нас. Как мы можем защитить нашу конфиденциальность и предотвратить злоупотребление этими данными?

Беспилотные автомобили собирают данные о наших маршрутах, привычках вождения и даже о том, что мы слушаем в машине. Алгоритмы социальных сетей собирают данные о наших интересах, друзьях и политических взглядах. Эти данные могут быть использованы для таргетированной рекламы, манипулирования общественным мнением или даже для слежки за нами. Необходимо установить четкие правила использования этих данных и обеспечить их защиту.

"Технологический прогресс не должен опережать человечность."

Принципы этичного развития ИИ

Чтобы избежать негативных последствий внедрения автономных систем, необходимо руководствоваться четкими этическими принципами. Вот некоторые из них:

- Принцип человекоцентричности: ИИ должен служить интересам человека и улучшать его жизнь.

- Принцип справедливости: ИИ должен быть беспристрастным и не допускать дискриминации.

- Принцип прозрачности: Работа ИИ должна быть понятной и объяснимой.

- Принцип ответственности: Должны быть четко определены лица, ответственные за действия ИИ.

- Принцип конфиденциальности: Необходимо защищать личные данные пользователей ИИ.

- Принцип безопасности: ИИ должен быть безопасным и не представлять угрозу для человека.

Эти принципы должны быть положены в основу разработки и внедрения автономных систем. Они должны быть закреплены в законодательстве и подкреплены общественным контролем.

Как мы можем повлиять на будущее ИИ?

Будущее ИИ зависит от нас. Мы можем и должны активно участвовать в формировании этических рамок для автономных систем.

Что мы можем сделать:

- Повышать свою осведомленность: Узнавать больше об ИИ, его возможностях и рисках.

- Участвовать в общественных дискуссиях: Выражать свое мнение по вопросам, связанным с ИИ.

- Поддерживать организации, занимающиеся этикой ИИ: Финансово или волонтерской помощью.

- Требовать от политиков и компаний соблюдения этических принципов: Писать письма, подписывать петиции, участвовать в акциях протеста.

- Задавать вопросы: Не стесняться спрашивать разработчиков и пользователей автономных систем о том, как они работают и какие этические принципы они соблюдают.

Только совместными усилиями мы сможем гарантировать, что ИИ будет развиваться в соответствии с нашими ценностями и приносить пользу человечеству.

Этические рамки для автономных систем принятия решений – это сложная и многогранная тема, требующая постоянного внимания и обсуждения. Мы должны активно участвовать в этом процессе, чтобы гарантировать, что ИИ будет развиваться в соответствии с нашими ценностями и приносить пользу человечеству. От этого зависит будущее нашей цивилизации.

Подробнее

| Этика искусственного интеллекта | Автономные системы принятия решений | Ответственность за ИИ | Предвзятость алгоритмов | Прозрачность ИИ |

|---|---|---|---|---|

| Конфиденциальность данных и ИИ | Безопасность искусственного интеллекта | Этические принципы ИИ | Регулирование искусственного интеллекта | Будущее искусственного интеллекта |