- Этические дилеммы в разработке ИИ для дронов: Наш опыт и размышления

- Автономность и ответственность

- Конфиденциальность и наблюдение

- Военное применение и летальное оружие

- Предвзятость и дискриминация

- Прозрачность и объяснимость

- Подзаголовок с примером таблицы

- Подзаголовок с примером списка

- Подзаголовок с примером нумерованного списка

Этические дилеммы в разработке ИИ для дронов: Наш опыт и размышления

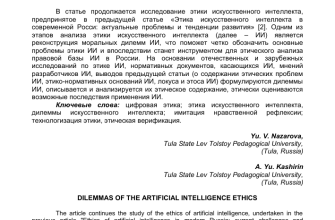

В современном мире дроны, оснащенные искусственным интеллектом (ИИ), становятся все более распространенными․ Они используются в самых разных областях: от доставки товаров и мониторинга окружающей среды до сельского хозяйства и обеспечения безопасности․ Однако, вместе с огромным потенциалом, разработка и применение ИИ для дронов порождает целый ряд сложных этических вопросов, которые требуют внимательного рассмотрения․ Мы, как разработчики и исследователи в этой области, сталкиваемся с этими дилеммами ежедневно и хотим поделиться нашим опытом и размышлениями․

Наша цель – не просто создать технологически совершенные дроны, но и убедиться, что они используются ответственно и этично․ Это требует постоянного анализа потенциальных рисков и разработки стратегий для их минимизации․ В этой статье мы подробно рассмотрим основные этические дилеммы, с которыми мы сталкиваемся, и предложим возможные подходы к их решению․

Автономность и ответственность

Одной из ключевых этических проблем являеться степень автономности, которую мы предоставляем дронам с ИИ․ Чем больше свободы действий получает дрон, тем сложнее определить, кто несет ответственность за его решения и действия․ Если дрон, действующий автономно, совершает ошибку или причиняет вред, кто виноват? Разработчик? Оператор? Или сам ИИ?

Мы считаем, что необходимо найти баланс между автономностью и контролем․ С одной стороны, дроны должны обладать достаточной самостоятельностью для эффективного выполнения своих задач․ С другой стороны, необходимо предусмотреть механизмы контроля и вмешательства, которые позволят оператору в любой момент взять управление на себя или остановить дрон в случае необходимости․ Важно четко определить границы ответственности и разработать протоколы действий в нештатных ситуациях․

Конфиденциальность и наблюдение

Дроны, оснащенные камерами и другими сенсорами, способны собирать огромные объемы данных о людях и окружающей среде․ Это создает серьезные риски для конфиденциальности и может привести к злоупотреблениям․ Как обеспечить защиту частной жизни граждан, если дроны постоянно ведут наблюдение?

Мы убеждены, что необходимо разработать строгие правила и ограничения на сбор, хранение и использование данных, собранных дронами․ Необходимо информировать людей о том, что ведется наблюдение, и предоставлять им возможность контролировать, какие данные о них собираются и как они используются․ Кроме того, важно разработать технические решения, которые позволят минимизировать сбор данных и обеспечить анонимность․

Военное применение и летальное оружие

Использование дронов в военных целях вызывает особенно острые этические споры․ Вооруженные дроны, способные принимать решения об атаке самостоятельно, представляют серьезную угрозу для гуманитарного права и могут привести к случайным жертвам среди мирного населения․

Мы придерживаемся мнения, что использование дронов в качестве летального оружия должно быть строго регламентировано и ограничено․ Необходимо разработать международные соглашения, которые определят условия и порядок применения вооруженных дронов, а также установят ответственность за их использование․ Мы считаем, что принятие решений об атаке должно оставаться за человеком, а не за машиной․

"Технологический прогресс не должен затмевать этические принципы․ Мы должны использовать наши знания и умения для создания технологий, которые служат человечеству, а не наоборот․" ─ Альберт Эйнштейн

Предвзятость и дискриминация

ИИ, используемый в дронах, может быть подвержен предвзятости и дискриминации, если он обучен на нерепрезентативных или предвзятых данных․ Это может привести к тому, что дроны будут принимать несправедливые или дискриминационные решения в отношении определенных групп людей․

Мы уделяем большое внимание обеспечению справедливости и непредвзятости ИИ, используемого в наших дронах․ Мы тщательно отбираем и анализируем данные, на которых обучаются наши модели, и используем методы, которые позволяют выявлять и устранять предвзятость․ Мы также проводим регулярные проверки и тесты, чтобы убедиться, что наши дроны не дискриминируют людей по каким-либо признакам․

Прозрачность и объяснимость

Многие современные ИИ-системы, в т․ч․ используемые в дронах, являются "черными ящиками", то есть их внутреннее устройство и логика принятия решений непонятны даже разработчикам․ Это затрудняет выявление и исправление ошибок, а также снижает доверие к таким системам․

Мы стремимся к большей прозрачности и объяснимости ИИ, используемого в наших дронах․ Мы разрабатываем методы, которые позволяют "заглянуть внутрь" ИИ-системы и понять, почему она приняла то или иное решение․ Мы также стараемся сделать наши модели более понятными и предсказуемыми для операторов и пользователей․

Подзаголовок с примером таблицы

В качестве примера приведем таблицу с возможными сценариями использования дронов и соответствующими этическими рисками:

| Сценарий использования | Этические риски | Возможные решения |

|---|---|---|

| Доставка товаров | Нарушение конфиденциальности, шум, безопасность полетов | Шифрование данных, ограничение маршрутов, разработка безопасных систем управления |

| Мониторинг окружающей среды | Сбор данных без согласия, нарушение частной жизни | Информирование населения, анонимизация данных, ограничение зон наблюдения |

| Обеспечение безопасности | Неправомерное использование силы, дискриминация | Обучение ИИ на непредвзятых данных, контроль со стороны человека, разработка четких протоколов |

Подзаголовок с примером списка

Для более наглядного представления этических проблем, рассмотрим их в виде списка:

- Автономность и ответственность

- Конфиденциальность и наблюдение

- Военное применение и летальное оружие

- Предвзятость и дискриминация

- Прозрачность и объяснимость

Подзаголовок с примером нумерованного списка

Основные шаги для решения этических дилемм:

- Определение этических рисков

- Разработка стратегий минимизации рисков

- Внедрение технических и организационных мер

- Обучение и информирование персонала

- Регулярный мониторинг и аудит

Разработка ИИ для дронов – это сложная и ответственная задача, которая требует не только технических знаний и умений, но и глубокого понимания этических принципов․ Мы убеждены, что только совместными усилиями разработчиков, исследователей, политиков и общественности мы сможем создать дроны, которые будут служить человечеству и не причинять вреда․ Мы продолжаем работать над решением этих сложных вопросов и надеемся, что наш опыт и размышления будут полезны для других․

Подробнее

| Этика дронов с ИИ | Беспилотники и мораль | Автономные дроны риски | Приватность и дроны | Ответственность ИИ дронов |

|---|---|---|---|---|

| Летальное оружие дроны | Предвзятость в ИИ дронов | Прозрачность ИИ дронов | Этические принципы дронов | Регулирование дронов |

Статья готова․