- Этические дилеммы за гранью реальности: Как ИИ меняет виртуальные миры

- ИИ как архитектор виртуальной реальности

- Генерация контента и персонализация

- Создание реалистичных персонажей (NPC)

- Этические аспекты взаимодействия с ИИ-персонажами

- Риски и вызовы этичного ИИ в виртуальных мирах

- Борьба с предвзятостью и дискриминацией

- Предотвращение манипуляций и зависимости

- Будущее этичного ИИ в виртуальных мирах

- Необходимость регулирования и стандартизации

- Роль образования и осведомленности

- Практические шаги к этичному ИИ в виртуальной реальности

- Примеры успешных инициатив

Этические дилеммы за гранью реальности: Как ИИ меняет виртуальные миры

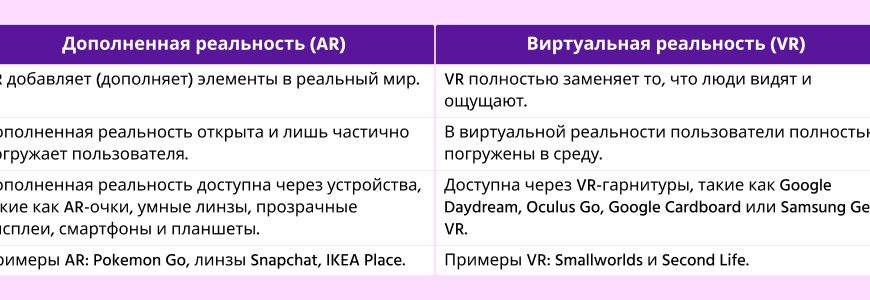

Виртуальные миры всегда манили нас возможностью уйти от рутины, испытать нечто новое, примерить на себя другую роль. Но с появлением искусственного интеллекта (ИИ) в этих мирах, границы размываются еще сильнее. Мы, как пользователи и творцы этих новых реальностей, сталкиваемся с вопросами, о которых раньше даже не задумывались. Какую ответственность мы несем за действия ИИ в виртуальной среде? Как защитить пользователей от манипуляций и злоупотреблений? Эти и многие другие вопросы требуют внимательного рассмотрения и поиска ответов.

В этой статье мы погрузимся в мир этических аспектов ИИ в создании виртуальных миров. Мы рассмотрим, как ИИ меняет наше взаимодействие с виртуальной реальностью, какие риски и возможности это несет, и какие шаги необходимо предпринять, чтобы обеспечить безопасное и справедливое будущее виртуальных миров.

ИИ как архитектор виртуальной реальности

Искусственный интеллект уже сегодня играет ключевую роль в создании и развитии виртуальных миров. Он используется для генерации контента, создания реалистичных персонажей, управления игровым процессом и даже для адаптации виртуальной среды к индивидуальным потребностям пользователя. Представьте себе мир, где каждый квест, каждый диалог и каждое взаимодействие уникальны, созданы специально для вас. ИИ делает это возможным.

Но вместе с этим возникает и ряд вопросов. Как обеспечить разнообразие контента, чтобы избежать однообразия и предсказуемости? Как избежать предвзятости в алгоритмах ИИ, чтобы не создавать виртуальные миры, отражающие лишь узкий набор взглядов и ценностей? Как гарантировать, что ИИ не будет использоваться для манипулирования пользователями или для распространения дезинформации?

Генерация контента и персонализация

ИИ способен генерировать огромные объемы контента для виртуальных миров: от ландшафтов и архитектурных сооружений до персонажей и диалогов. Это позволяет создавать более богатые и разнообразные миры, чем когда-либо прежде. Кроме того, ИИ может адаптировать контент к индивидуальным предпочтениям каждого пользователя, создавая персонализированный опыт.

- Преимущества:

- Увеличение разнообразия контента.

- Персонализация опыта пользователя.

- Экономия времени и ресурсов разработчиков.

- Риски:

- Возможность создания однообразного и предсказуемого контента.

- Усиление "пузыря фильтров" и ограничение кругозора пользователя.

- Использование ИИ для создания дезинформации и манипуляций.

Создание реалистичных персонажей (NPC)

ИИ позволяет создавать неигровых персонажей (NPC), которые ведут себя более реалистично и правдоподобно. Они могут учится, адаптироваться к действиям пользователя и даже проявлять эмоции. Это делает взаимодействие с виртуальным миром более захватывающим и иммерсивным.

Однако, чем более реалистичными становятся NPC, тем сложнее становится отличить их от реальных людей. Это может привести к этическим проблемам, особенно в контексте виртуальных отношений и социальных взаимодействий. Как защитить пользователей от обмана и злоупотреблений со стороны "умных" NPC? Как обеспечить прозрачность и честность в виртуальных отношениях?

Этические аспекты взаимодействия с ИИ-персонажами

Взаимодействие с ИИ-персонажами в виртуальных мирах поднимает важные этические вопросы. Например, если ИИ-персонаж проявляет эмоции и строит отношения с пользователем, несет ли разработчик ответственность за возможные негативные последствия для пользователя, такие как разочарование или эмоциональная зависимость? Необходимо ли информировать пользователя о том, что он взаимодействует с ИИ, а не с реальным человеком?

Кроме того, возникает вопрос об использовании ИИ-персонажей для сбора данных о пользователях. Если ИИ-персонаж собирает информацию о предпочтениях, интересах и эмоциональном состоянии пользователя, как эта информация будет использоваться и кто будет иметь к ней доступ? Необходимо ли получать согласие пользователя на сбор и использование его данных?

"Технологии нейтральны. Но то, как мы их используем, определяет, будут ли они служить добру или злу." ⸺ Вернер фон Браун

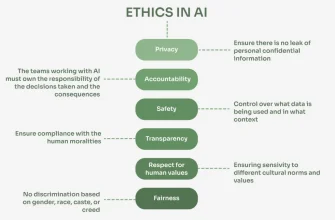

Риски и вызовы этичного ИИ в виртуальных мирах

Внедрение ИИ в виртуальные миры несет в себе не только огромный потенциал, но и ряд серьезных рисков. Нам необходимо быть готовыми к этим вызовам и разработать стратегии для их решения.

- Предвзятость и дискриминация: Алгоритмы ИИ могут быть предвзятыми, отражая предубеждения, присутствующие в данных, на которых они обучались. Это может привести к созданию виртуальных миров, дискриминирующих определенные группы людей.

- Манипуляции и зависимость: ИИ может использоваться для манипулирования пользователями и вызывания у них зависимости от виртуального мира.

- Нарушение конфиденциальности: ИИ может собирать и анализировать большие объемы данных о пользователях, что может привести к нарушению их конфиденциальности.

- Размытие границ между реальностью и виртуальностью: Чем более реалистичными становятся виртуальные миры, тем сложнее становится отличить их от реальности. Это может привести к психологическим проблемам и дезориентации.

- Ответственность за действия ИИ: Кто несет ответственность за действия ИИ в виртуальном мире? Разработчик? Пользователь? Сам ИИ? Этот вопрос требует четкого определения.

Борьба с предвзятостью и дискриминацией

Чтобы избежать предвзятости и дискриминации в виртуальных мирах, необходимо тщательно следить за данными, на которых обучаются алгоритмы ИИ. Важно использовать разнообразные и репрезентативные наборы данных, а также применять методы для выявления и устранения предвзятости. Кроме того, необходимо разрабатывать алгоритмы ИИ, которые учитывают культурные и социальные особенности различных групп людей.

Одним из способов борьбы с предвзятостью является использование "состязательных сетей" (GANs), которые позволяют обучать ИИ выявлять и устранять предвзятость в данных. Другой подход заключается в использовании "объяснимого ИИ" (XAI), который позволяет понять, как ИИ принимает решения, и выявить возможные источники предвзятости;

Предотвращение манипуляций и зависимости

Чтобы предотвратить манипуляции и зависимость от виртуальных миров, необходимо разрабатывать системы, которые ограничивают время, проводимое пользователем в виртуальной среде, и предупреждают о возможных рисках. Важно также обучать пользователей критическому мышлению и помогать им отличать реальность от виртуальности.

Разработчики виртуальных миров должны стремиться к созданию сбалансированного опыта, который не вызывает у пользователей нездоровой зависимости. Необходимо избегать использования техник "темного UX", которые направлены на манипулирование пользователями и удержание их в виртуальной среде любой ценой.

Будущее этичного ИИ в виртуальных мирах

Будущее виртуальных миров с ИИ зависит от того, как мы будем решать этические вопросы сегодня. Нам необходимо разработать четкие правила и нормы, которые будут регулировать использование ИИ в виртуальной среде и защищать права и интересы пользователей.

Это требует совместных усилий разработчиков, исследователей, политиков и пользователей. Нам необходимо создать открытый и прозрачный диалог, чтобы обсудить все аспекты этичного ИИ в виртуальных мирах и разработать стратегии для создания безопасного и справедливого будущего.

Необходимость регулирования и стандартизации

Для обеспечения этичного использования ИИ в виртуальных мирах необходимы регулирование и стандартизация. Необходимо разработать четкие правила и нормы, которые будут регулировать сбор и использование данных, создание и распространение контента, а также взаимодействие с ИИ-персонажами. Эти правила должны быть основаны на принципах прозрачности, справедливости и уважения к правам человека.

Кроме того, необходимо разработать стандарты для оценки этичности алгоритмов ИИ и виртуальных миров. Эти стандарты должны учитывать различные аспекты, такие как предвзятость, дискриминация, манипуляции и конфиденциальность. Независимые организации должны проводить аудит и сертификацию виртуальных миров, чтобы гарантировать их соответствие этическим стандартам.

Роль образования и осведомленности

Образование и осведомленность играют ключевую роль в формировании этичного отношения к ИИ в виртуальных мирах. Необходимо обучать пользователей критическому мышлению и помогать им отличать реальность от виртуальности. Важно также информировать пользователей о возможных рисках и последствиях использования ИИ в виртуальной среде.

Образовательные программы должны включать в себя темы, связанные с этикой ИИ, конфиденциальностью данных, цифровой грамотностью и критическим мышлением. Необходимо также разрабатывать ресурсы для родителей и учителей, которые помогут им обучать детей безопасному и ответственному использованию виртуальных миров.

Практические шаги к этичному ИИ в виртуальной реальности

Чтобы воплотить в жизнь принципы этичного ИИ в виртуальных мирах, необходимо предпринять ряд конкретных шагов. Эти шаги должны включать в себя разработку этических кодексов, создание механизмов обратной связи с пользователями, а также проведение исследований и разработок в области этичного ИИ.

- Разработка этических кодексов для разработчиков виртуальных миров.

- Создание механизмов обратной связи с пользователями для выявления и устранения этических проблем.

- Проведение исследований и разработок в области этичного ИИ.

- Создание независимых органов для контроля за соблюдением этических норм.

- Повышение осведомленности пользователей об этических аспектах ИИ в виртуальных мирах.

Примеры успешных инициатив

Уже сегодня существуют примеры успешных инициатив, направленных на обеспечение этичного использования ИИ в виртуальных мирах. Например, некоторые компании разрабатывают этические кодексы для своих сотрудников, а другие создают механизмы обратной связи с пользователями для выявления и устранения этических проблем. Кроме того, проводятся исследования и разработки в области этичного ИИ, направленные на создание алгоритмов, которые учитывают этические аспекты.

Одним из примеров является проект "AI Ethics Lab", который занимается исследованиями в области этики ИИ и разработкой инструментов для оценки этичности алгоритмов. Другим примером является инициатива "Partnership on AI", которая объединяет ведущие компании и исследовательские организации для разработки лучших практик в области этики ИИ.

Мы верим, что, объединив усилия, мы сможем создать виртуальные миры, которые будут не только захватывающими и интересными, но и этичными и безопасными для всех пользователей. Только тогда мы сможем в полной мере реализовать потенциал ИИ в виртуальной реальности и создать будущее, в котором технологии служат на благо человечества.

Подробнее

| Этика виртуальной реальности | ИИ и виртуальные миры | Этические проблемы ИИ | Виртуальная реальность и мораль | ИИ в геймдеве этика |

|---|---|---|---|---|

| Ответственность за ИИ | Безопасность виртуальных миров | Этика создания ИИ | Регулирование виртуальной реальности | Манипуляции в виртуальных мирах |