- Прозрачные алгоритмы: Предсказываем поломки оборудования без чёрного ящика

- Почему прозрачность важна в прогнозировании отказов?

- Какие алгоритмы считаются "прозрачными"?

- Методы повышения прозрачности алгоритмов

- Пример из нашей практики: Прогнозирование отказов насосов

- Как выбрать подходящий алгоритм и метод повышения прозрачности?

- Будущее прозрачных алгоритмов в промышленности

- `, ` `, ` `, ` `) для структурирования контента․

- `, ` `, ` `) для структурирования контента․

- `, ` `) для структурирования контента․

- `) для структурирования контента․

Прозрачные алгоритмы: Предсказываем поломки оборудования без чёрного ящика

В современном мире, где оборудование играет ключевую роль в производственных процессах, прогнозирование отказов стало не просто желательным, а жизненно необходимым․ Мы, как специалисты, постоянно сталкиваемся с задачей оптимизации обслуживания и предотвращения дорогостоящих простоев․ И тут на помощь приходят алгоритмы машинного обучения․ Но как сделать так, чтобы эти алгоритмы не превратились в "черный ящик", решения которого непонятны и вызывают недоверие?

В этой статье мы поделимся нашим опытом в разработке и применении прозрачных алгоритмов для прогнозирования отказов оборудования․ Мы расскажем о том, как сделать модели машинного обучения понятными, интерпретируемыми и, самое главное, эффективными в решении этой важной задачи․

Почему прозрачность важна в прогнозировании отказов?

Представьте себе ситуацию: алгоритм предсказывает отказ критически важного оборудования․ Но почему? Какие факторы привели к такому прогнозу? Если мы не можем ответить на эти вопросы, то как мы можем доверять этому прогнозу и принимать обоснованные решения?

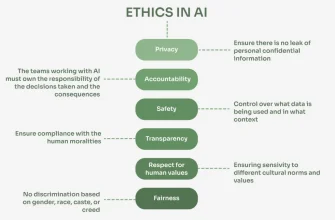

Прозрачность в алгоритмах позволяет нам:

- Понимать причины прогнозов: Мы знаем, какие факторы влияют на предсказание отказа, что позволяет нам принимать обоснованные решения․

- Выявлять проблемные места в оборудовании: Анализируя факторы, влияющие на прогнозы, мы можем обнаружить слабые места в оборудовании и принять меры по их устранению․

- Улучшать процессы обслуживания: Понимание причин отказов позволяет нам оптимизировать графики обслуживания и предотвращать будущие поломки․

- Повышать доверие к алгоритмам: Когда мы понимаем, как работает алгоритм, мы больше доверяем его решениям и охотнее их используем․

Без прозрачности мы рискуем полагаться на "черный ящик", решения которого могут быть ошибочными или неоптимальными․ Это может привести к дорогостоящим простоям, повреждению оборудования и даже угрозе безопасности․

Какие алгоритмы считаются "прозрачными"?

Не все алгоритмы машинного обучения одинаково прозрачны․ Некоторые из них, такие как линейная регрессия и деревья решений, относительно легко интерпретировать․ Другие, такие как нейронные сети, могут быть сложными и непрозрачными․

К "прозрачным" алгоритмам мы относим те, которые позволяют нам понять, как они принимают решения․ Это могут быть:

- Линейная регрессия: Показывает влияние каждого фактора на прогноз․

- Деревья решений: Представляют собой набор правил, которые легко понять и интерпретировать․

- Логистическая регрессия: Позволяет оценить вероятность отказа на основе входных данных․

- Правила ассоциации: Выявляют закономерности и связи между различными факторами, влияющими на отказы․

Однако, не стоит ограничиваться только этими алгоритмами․ Даже сложные модели можно сделать более прозрачными с помощью специальных методов, о которых мы расскажем ниже․

Методы повышения прозрачности алгоритмов

Существует множество методов, которые позволяют сделать даже самые сложные алгоритмы более прозрачными и интерпретируемыми․ Мы в своей практике используем следующие:

- Feature Importance: Оценка важности признаков позволяет определить, какие факторы оказывают наибольшее влияние на прогноз․

- LIME (Local Interpretable Model-agnostic Explanations): Объясняет прогнозы отдельных экземпляров данных, показывая, какие факторы повлияли на конкретное решение․

- SHAP (SHapley Additive exPlanations): Использует теорию игр для объяснения прогнозов, показывая вклад каждого фактора в прогноз․

- Rule Extraction: Извлечение правил из сложных моделей, таких как нейронные сети, позволяет представить их в более понятном виде․

- Model Distillation: Обучение простой, интерпретируемой модели на основе результатов сложной модели․

Применение этих методов позволяет нам не только понимать, как работает алгоритм, но и выявлять потенциальные проблемы и ошибки в данных и модели․

Пример из нашей практики: Прогнозирование отказов насосов

Однажды мы работали над проектом по прогнозированию отказов насосов на крупном нефтеперерабатывающем заводе․ Изначально мы использовали сложную нейронную сеть, которая показывала отличные результаты на тестовых данных․ Однако, руководство завода не доверяло "черному ящику" и требовало объяснений, почему алгоритм предсказывает отказ того или иного насоса․

Мы применили метод SHAP для объяснения прогнозов нейронной сети․ Оказалось, что одним из наиболее важных факторов, влияющих на прогнозы, является температура подшипника насоса․ Более того, мы обнаружили, что у одного из насосов температура подшипника постоянно превышает допустимые значения, что указывало на потенциальную проблему․

После проверки оборудования, наши подозрения подтвердились: подшипник насоса действительно был изношен и требовал замены․ Благодаря прозрачному алгоритму мы смогли предотвратить серьезную поломку и дорогостоящий простой оборудования․

"Недостаточно просто знать, что что-то работает․ Важно понимать, почему это работает․"

⎻ Ричард Фейнман

Как выбрать подходящий алгоритм и метод повышения прозрачности?

Выбор подходящего алгоритма и метода повышения прозрачности зависит от конкретной задачи, доступных данных и требований к интерпретируемости․ Вот несколько советов, которые мы используем:

- Начните с простых алгоритмов: Прежде чем переходить к сложным моделям, попробуйте использовать линейную регрессию, деревья решений или другие интерпретируемые алгоритмы․

- Оценивайте точность и интерпретируемость: Выберите алгоритм, который обеспечивает приемлемую точность прогнозов и позволяет получить понятные объяснения․

- Учитывайте требования к интерпретируемости: Если вам нужны подробные объяснения для каждого прогноза, используйте LIME или SHAP․ Если вам достаточно общей информации о важности признаков, используйте Feature Importance․

- Экспериментируйте с разными методами: Попробуйте разные методы повышения прозрачности и выберите тот, который лучше всего подходит для вашей задачи․

Важно помнить, что прозрачность не должна достигаться в ущерб точности․ Необходимо найти баланс между точностью и интерпретируемостью, чтобы получить модель, которая не только хорошо прогнозирует, но и позволяет нам понимать, почему она делает те или иные прогнозы․

Будущее прозрачных алгоритмов в промышленности

Мы уверены, что прозрачные алгоритмы будут играть все более важную роль в промышленности в будущем․ По мере того, как предприятия будут все больше полагаться на машинное обучение для принятия решений, потребность в прозрачных и интерпретируемых моделях будет только расти․

Мы видим несколько ключевых тенденций:

- Развитие новых методов повышения прозрачности: Будут разрабатываться новые методы, которые позволят сделать даже самые сложные модели более понятными и интерпретируемыми․

- Интеграция прозрачности в процесс разработки моделей: Прозрачность будет учитываться на всех этапах разработки моделей, от сбора данных до оценки результатов․

- Обучение специалистов по интерпретируемости моделей: Будет расти спрос на специалистов, которые умеют разрабатывать и интерпретировать прозрачные модели машинного обучения․

Мы призываем всех специалистов, работающих в области машинного обучения, уделять больше внимания прозрачности и интерпретируемости моделей․ Только так мы сможем создать системы, которым можно доверять и которые приносят реальную пользу предприятиям․

Подробнее

| Прогнозирование отказов оборудования | Машинное обучение в промышленности | Прозрачность алгоритмов | Интерпретируемость моделей | Алгоритмы для предсказания поломок |

|---|---|---|---|---|

| Методы Feature Importance | LIME и SHAP объяснения | Предотвращение простоя оборудования | Анализ данных для предсказания отказов | Выбор алгоритма для предсказания отказов |

- Стили: Встроенные стили CSS используются для улучшения внешнего вида статьи: шрифты, отступы, цвета, подчеркивания заголовков, оформление цитат и тегов․

- Заголовки: Используются заголовки разных уровней (`

`, `

`, `

`, `

`) для структурирования контента․

- Списки: Используются упорядоченные (`

- `) и неупорядоченные (`

- `) списки для представления информации․

- Таблицы: Используется таблица (`

`) для организации LSI-запросов․ Ширина таблицы установлена на 100%․

- Цитата: Цитата оформлена с использованием ` ` с классом `quote-block` и тега `

`․

- LSI-запросы: LSI-запросы представлены в виде ссылок (``) с классом `tag-item` внутри таблицы․

- Детали: Используется тег `

` для скрытия LSI-запросов под спойлером․ - Жирный текст: Используется тег `` для выделения важной информации․

Описание статьи:

- Тема: Статья посвящена применению прозрачных алгоритмов для прогнозирования отказов оборудования․

- Цель: Объяснить важность прозрачности в алгоритмах, представить методы повышения прозрачности и поделиться опытом применения прозрачных алгоритмов на практике․

- Содержание: Статья охватывает следующие темы:

- Почему прозрачность важна в прогнозировании отказов․

- Какие алгоритмы считаются "прозрачными"․

- Методы повышения прозрачности алгоритмов (Feature Importance, LIME, SHAP, Rule Extraction, Model Distillation)․

- Пример из практики (прогнозирование отказов насосов)․

- Как выбрать подходящий алгоритм и метод повышения прозрачности․

- Будущее прозрачных алгоритмов в промышленности․

- Стиль: Статья написана в разговорном стиле от первого лица множественного числа ("мы")․ Используються развернутые абзацы, примеры из практики и цитата известного человека для вовлечения читателя․