Распознавание эмоций: От черного ящика к прозрачному окну

Мы живем в эпоху, когда искусственный интеллект (ИИ) проникает во все сферы нашей жизни; Системы распознавания эмоций – не исключение․ Они используются в маркетинге, HR, медицине и даже в правоохранительных органах․ Но как эти системы "чувствуют" наши эмоции? Насколько мы можем доверять их выводам? И самое главное – насколько прозрачен этот процесс?

На протяжении многих лет мы, как и многие другие, верили в магию технологий․ Нам казалось, что достаточно ввести данные, и алгоритм выдаст нам готовый ответ․ Однако с системами распознавания эмоций все оказалось гораздо сложнее․ Мы столкнулись с проблемой "черного ящика" – мы видим результат, но не понимаем, как он был получен․ Это вызывает закономерные вопросы о справедливости, предвзятости и возможности манипулирования․

В этой статье мы погрузимся в мир распознавания эмоций, чтобы разобраться, что скрывается за фасадом сложных алгоритмов и нейронных сетей․ Мы расскажем о нашем опыте, о тех проблемах, с которыми мы столкнулись, и о том, как мы пытаемся сделать этот процесс более прозрачным и понятным для всех․

Что такое распознавание эмоций и как оно работает?

Распознавание эмоций – это технология, которая позволяет компьютерам "считывать" и интерпретировать человеческие эмоции․ Обычно это делается с помощью анализа различных параметров, таких как:

- Выражение лица: Анализ мимики, движения мышц лица․

- Голос: Анализ тона, тембра, скорости речи․

- Текст: Анализ слов, фраз, стиля письма․

- Физиологические данные: Анализ сердечного ритма, потливости, температуры тела․

Большинство современных систем распознавания эмоций используют методы машинного обучения, особенно нейронные сети․ Эти сети обучаются на огромных массивах данных, содержащих примеры различных эмоций, и постепенно учатся распознавать их в новых ситуациях․

Однако, как мы уже говорили, процесс обучения и работы этих систем часто остается непрозрачным․ Мы не всегда знаем, какие данные использовались для обучения, какие факторы учитывались при анализе, и как принималось решение о той или иной эмоции․ Это создает потенциал для ошибок, предвзятости и злоупотреблений․

Проблема "черного ящика" в распознавании эмоций

Представьте себе ситуацию: вам отказывают в кредите на основании анализа вашего выражения лица во время онлайн-собеседования․ Система распознавания эмоций определила, что вы выглядите "неуверенно" или "тревожно"․ Но так ли это на самом деле? Может быть, у вас просто был плохой день, или вы нервничали из-за технических проблем?

Эта ситуация иллюстрирует проблему "черного ящика" в распознавании эмоций․ Мы не знаем, как система пришла к такому выводу, и не можем оспорить его․ Мы просто получаем готовый результат, который может повлиять на нашу жизнь․

Существует несколько причин, по которым системы распознавания эмоций могут быть непрозрачными:

- Сложность алгоритмов: Современные нейронные сети очень сложны и трудно поддаются интерпретации․ Даже разработчики не всегда могут объяснить, почему сеть приняла то или иное решение․

- Закрытые данные: Данные, используемые для обучения систем распознавания эмоций, часто являются коммерческой тайной․ Мы не знаем, какие лица, голоса или тексты использовались для обучения, и насколько они репрезентативны для различных групп населения․

- Отсутствие стандартов: В настоящее время не существует единых стандартов для оценки качества и надежности систем распознавания эмоций․ Это затрудняет сравнение различных систем и выявление потенциальных проблем․

"Технологии должны быть прозрачными и понятными для тех, кто их использует․ В противном случае они могут стать инструментом манипулирования и контроля․" ⎯ Джулиан Ассанж

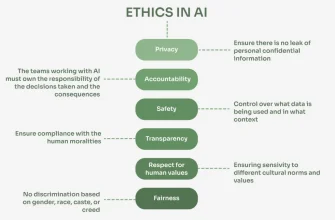

Почему прозрачность так важна?

Прозрачность в системах распознавания эмоций – это не просто вопрос этики․ Это необходимое условие для того, чтобы эти системы использовались справедливо, надежно и эффективно․ Вот несколько причин, почему прозрачность так важна:

- Справедливость: Прозрачность позволяет выявить и устранить предвзятость в алгоритмах и данных․ Это гарантирует, что системы распознавания эмоций не будут дискриминировать людей по признаку расы, пола, возраста или других характеристик․

- Надежность: Прозрачность позволяет оценить качество и надежность систем распознавания эмоций․ Мы можем проверить, насколько хорошо они работают в различных условиях и с разными людьми․

- Подотчетность: Прозрачность делает разработчиков и пользователей систем распознавания эмоций более подотчетными за их действия․ Если система совершает ошибку, мы можем выяснить, почему это произошло, и принять меры для предотвращения подобных ошибок в будущем․

- Доверие: Прозрачность укрепляет доверие к системам распознавания эмоций․ Когда мы понимаем, как эти системы работают, мы более склонны доверять их выводам․

Наш опыт: как мы добиваемся прозрачности

Мы в своей работе стремимся к максимальной прозрачности в системах распознавания эмоций․ Мы понимаем, что это сложная задача, но мы уверены, что это необходимо для того, чтобы эти системы приносили пользу обществу․

Вот некоторые шаги, которые мы предпринимаем для достижения прозрачности:

- Открытые данные: Мы стараемся использовать открытые и общедоступные данные для обучения наших систем․ Если это невозможно, мы тщательно документируем данные, которые мы используем, и объясняем, почему мы выбрали именно их․

- Интерпретируемые алгоритмы: Мы предпочитаем использовать алгоритмы, которые легко интерпретировать․ Мы стараемся избегать сложных нейронных сетей, которые работают как "черный ящик"․

- Объяснимость решений: Мы разрабатываем методы, которые позволяют объяснить, почему система приняла то или иное решение․ Мы показываем, какие факторы повлияли на результат, и как они были взвешены․

- Оценка предвзятости: Мы проводим регулярную оценку предвзятости наших систем․ Мы проверяем, не дискриминируют ли они какие-либо группы населения․

- Открытый код: Мы публикуем код наших систем, чтобы другие исследователи могли его изучить и проверить․

Конечно, мы понимаем, что это только начало пути․ Нам предстоит еще много работы, чтобы сделать системы распознавания эмоций действительно прозрачными и справедливыми; Но мы верим, что это возможно, и мы будем продолжать двигаться в этом направлении․

Что можно сделать, чтобы повысить прозрачность?

Повышение прозрачности в системах распознавания эмоций – это задача, которая требует усилий со стороны всех заинтересованных сторон: разработчиков, исследователей, регуляторов и пользователей․

Вот несколько рекомендаций:

- Разработчикам: Используйте открытые данные, интерпретируемые алгоритмы и методы объяснимости решений․ Проводите регулярную оценку предвзятости․ Публикуйте код своих систем․

- Исследователям: Разрабатывайте новые методы повышения прозрачности и интерпретируемости алгоритмов․ Изучайте потенциальные источники предвзятости в данных и алгоритмах․

- Регуляторам: Разрабатывайте стандарты для оценки качества и надежности систем распознавания эмоций․ Устанавливайте требования к прозрачности и подотчетности․

- Пользователям: Задавайте вопросы о том, как работают системы распознавания эмоций․ Требуйте объяснений, если вы не понимаете, почему система приняла то или иное решение․ Сообщайте о случаях предвзятости или дискриминации․

Системы распознавания эмоций обладают огромным потенциалом для улучшения нашей жизни․ Они могут помочь нам в медицине, образовании, маркетинге и многих других областях․ Но чтобы этот потенциал был реализован в полной мере, необходимо обеспечить прозрачность и справедливость этих систем․

Прозрачность – это не просто модное слово․ Это необходимое условие для того, чтобы мы могли доверять технологиям, которые так сильно влияют на нашу жизнь․ Мы верим, что с помощью совместных усилий мы можем сделать системы распознавания эмоций более прозрачными, справедливыми и полезными для всех․

Подробнее

| Распознавание эмоций | Искусственный интеллект | Машинное обучение | Нейронные сети | Этичное ИИ |

|---|---|---|---|---|

| Предвзятость алгоритмов | Прозрачность ИИ | Объяснимость ИИ | Распознавание лиц | Анализ тональности |