Утилитарный подход к этике ИИ: Максимизация пользы в мире алгоритмов

В эпоху стремительного развития искусственного интеллекта (ИИ) мы сталкиваемся с множеством этических дилемм․ Как убедится, что ИИ служит интересам человечества, а не наоборот? Как разрешить конфликты между разными ценностями и интересами? Один из возможных ответов – утилитарный подход, который предлагает оценивать действия и решения ИИ с точки зрения их общей полезности․

Мы, как наблюдатели и участники этого процесса, видим, что утилитаризм, с его акцентом на максимизацию счастья и благополучия для наибольшего числа людей, может стать ценным инструментом для навигации в сложном мире этики ИИ․ Однако, как и любой этический фреймворк, утилитаризм не лишен недостатков и требует критического осмысления․

Что такое утилитаризм?

Утилитаризм – это этическая теория, которая утверждает, что наилучшим действием является то, которое максимизирует общее счастье или благополучие․ В своей простейшей форме, утилитаризм сводится к принципу "наибольшее счастье для наибольшего числа людей"․ Эта идея берет свои корни в трудах таких философов, как Джереми Бентам и Джон Стюарт Милль․

Мы считаем важным подчеркнуть, что утилитаризм не является эгоистичной философией․ Он требует учитывать интересы всех заинтересованных сторон, а не только собственные․ Это делает его привлекательным для применения в контексте ИИ, где решения алгоритмов могут оказывать влияние на жизни миллионов людей․

Применение утилитаризма к этике ИИ

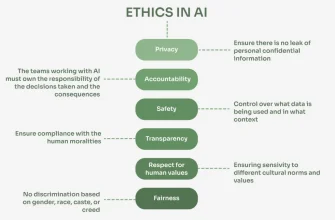

Когда мы говорим об этике ИИ, утилитарный подход может помочь нам ответить на следующие вопросы:

- Как разработать алгоритмы, которые будут принимать решения, приносящие наибольшую пользу обществу?

- Как разрешать конфликты между разными целями и ценностями, например, между конфиденциальностью и безопасностью?

- Как обеспечить справедливость и равенство в применении ИИ, чтобы он не усиливал существующее неравенство?

Представьте себе беспилотный автомобиль, который должен решить, кого спасти в случае неизбежного столкновения: пассажиров или пешеходов․ Утилитарный подход может предложить запрограммировать автомобиль таким образом, чтобы он выбирал вариант, который приведет к наименьшему числу жертв․ Это может быть трудным решением, но оно основано на принципе максимизации общей пользы․

Критика утилитаризма в контексте ИИ

Несмотря на свою привлекательность, утилитарный подход к этике ИИ сталкивается с рядом серьезных вызовов․ Мы должны признать, что утилитаризм не всегда дает простые и однозначные ответы․

- Проблема измерения счастья: Как измерить счастье или благополучие и сравнить его между разными людьми?

- Проблема предсказания последствий: Как точно предсказать все последствия действий ИИ, особенно в долгосрочной перспективе?

- Проблема справедливости: Может ли утилитарный подход привести к несправедливым результатам, когда интересы меньшинства приносятся в жертву интересам большинства?

Например, алгоритм, оптимизирующий распределение ресурсов здравоохранения, может решить направить больше ресурсов на лечение молодых людей, у которых больше шансов на выздоровление, чем на лечение пожилых людей․ Хотя это может максимизировать общее количество спасенных жизней, это может быть воспринято как несправедливое по отношению к пожилым людям․

"Вопрос не в том, могут ли они рассуждать? И не в том, могут ли они говорить? А в том, могут ли они страдать?" ⸺ Джереми Бентам

Альтернативные подходы к этике ИИ

Мы считаем, что важно рассматривать утилитаризм не как единственно возможный, а как один из многих подходов к этике ИИ․ Существуют и другие этические теории, которые могут быть полезны в этой области:

- Деонтология: Подход, основанный на соблюдении определенных правил и обязанностей, независимо от последствий․

- Этика добродетели: Подход, ориентированный на развитие моральных качеств, таких как честность, справедливость и сочувствие․

- Этика заботы: Подход, подчеркивающий важность отношений и заботы о других․

Каждый из этих подходов имеет свои сильные и слабые стороны, и мы должны использовать их в сочетании, чтобы создать более комплексную и сбалансированную этику ИИ․

Будущее утилитарного подхода к этике ИИ

Несмотря на все трудности, мы уверены, что утилитарный подход может сыграть важную роль в формировании этики ИИ․ Однако для этого необходимо преодолеть ряд вызовов:

- Разработать более точные и надежные методы измерения и сравнения счастья и благополучия․

- Улучшить методы прогнозирования последствий действий ИИ, используя машинное обучение и другие передовые технологии․

- Создать механизмы, которые будут обеспечивать справедливость и равенство в применении ИИ, даже если это означает отказ от максимизации общей пользы․

Мы должны помнить, что этика ИИ – это не статичная догма, а динамичный процесс, который требует постоянного обсуждения и переосмысления․ Мы, как общество, должны активно участвовать в этом процессе, чтобы создать ИИ, который будет служить нашим интересам и ценностям․

Утилитарный подход к этике ИИ предлагает ценный инструмент для принятия решений, максимизирующих пользу для общества․ Однако он не является панацеей и требует критического осмысления и дополнения другими этическими подходами․ Мы призываем к дальнейшему исследованию и обсуждению этических вопросов, связанных с ИИ, чтобы обеспечить его ответственное и благотворное развитие․

Подробнее

| LSI Запрос 1 | LSI Запрос 2 | LSI Запрос 3 | LSI Запрос 4 | LSI Запрос 5 |

|---|---|---|---|---|

| Этика искусственного интеллекта | Утилитаризм в ИИ | Принципы утилитаризма | Моральные дилеммы ИИ | Справедливость в ИИ |

| Утилитарная этика | Последствия ИИ | Беспилотные автомобили этика | Этика машинного обучения | Утилитаризм критика |